Ce texte est un « article presslib’ » (*)

Vous vous souvenez de Nanex ? C’est la firme qui récolte des données relatives aux opérations sur les marchés boursiers et qui avait mis en évidence, à l’aide de très beaux graphiques d’ailleurs, la manipulation des cours par des robots « honnêtes », je veux dire ceux qui se contentent de faire monter les cours. J’avais reproduit quelques-uns de ces graphiques dans un billet ici ; j’ai discuté la question dans Le capitalisme à l’agonie (Fayard 2011), aux pages 136 à 161

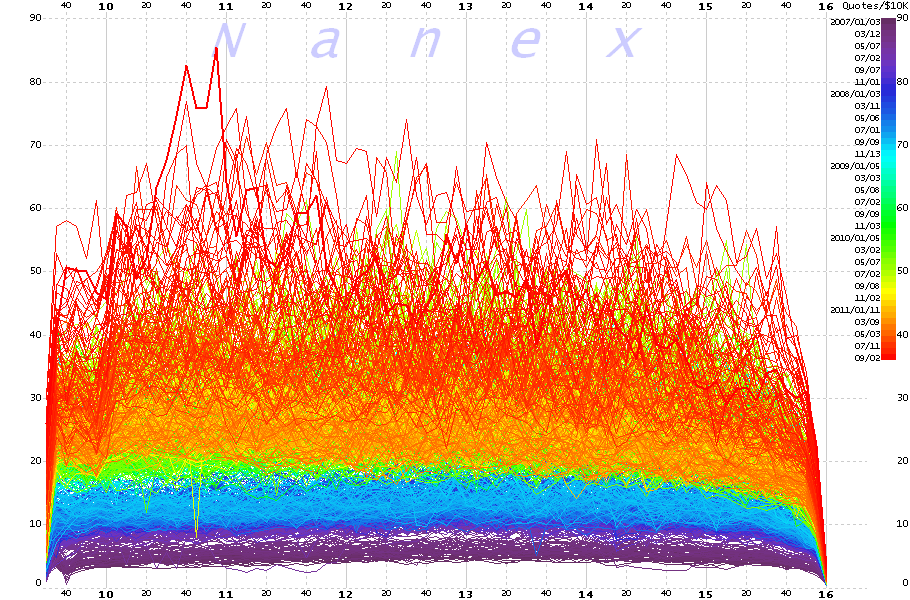

Aujourd’hui, Nanex nous offre une autre belle image : qu’est-ce qui se passe quand il n’y a plus que des robots à la Bourse ? La réponse fera plaisir à certains : « Ça ne paie plus ! » Pourquoi ? Parce qu’y gagner quelque chose revient de plus en plus cher.

J’avais montré dans une simulation informatique que j’avais faite (Kyoto 2006) que pour que la Bourse fonctionne sans krach, il fallait qu’il y ait en permanence 50 % d’intervenants (acheteurs et vendeurs) qui parient juste sur le fait que le prix va baisser ou grimper, et 50 % qui se trompent, autrement dit, il fallait que notre capacité à prédire juste l’évolution du prix à la Bourse ne dépasse pas le rendement du simple pile ou face. Mais les robots sont bien meilleurs que nous. Non pas qu’ils sachent lire l’avenir, mais parce qu’ils ont la capacité de cartographier entièrement l’ensemble des offres à l’achat et à la vente présentes sur le marché. Ils le font en faisant semblant d’acheter ou de vendre mais pour se rétracter aussitôt : en annulant l’opération en cours. Résultat, la proportion d’opérations engagées qui aboutissent véritablement à une transaction (achat/vente) chute et le coût de chaque transaction augmente (je rapporte dans Le capitalisme à l’agonie – p. 156 – des chiffres mentionnés par la commission d’enquête sur le krach éclair du 6 mai 2010 : 27.000 opérations en 14 secondes, ne débouchant que sur 200 transactions).

Le graphique de Nanex montre des opérations à la Bourse de New York, du 1er janvier 2007 au 14 septembre 2011. Les plus anciennes sont en violet, les plus récentes en rouge de plus en plus vif. En abscisse, c’est-à-dire l’axe horizontal, les heures d’ouverture du marché : de 9h30 à 16h00. En ordonnée, c’est-à-dire l’axe vertical, le nombre d’opérations nécessaires pour traiter l’équivalent de 10.000 $.

© Nanex (cliquez sur le graphique pour l’agrandir)

Comme vous le voyez, la situation se dégrade très rapidement : la dernière séance enregistrée, celle de mercredi dernier, 14 septembre, est en trait rouge épais.

À la Bourse de New York, ces jours-ci, la loi de la baisse tendancielle du taux de profit dont parlait Karl Marx est en pleine forme. Faut-il fermer les Bourses ? Pas la peine de se gratter la tête : les ordinateurs sont en train de régler le problème, et à toute allure !

(*) Un « article presslib’ » est libre de reproduction numérique en tout ou en partie à condition que le présent alinéa soit reproduit à sa suite. Paul Jorion est un « journaliste presslib’ » qui vit exclusivement de ses droits d’auteurs et de vos contributions. Il pourra continuer d’écrire comme il le fait aujourd’hui tant que vous l’y aiderez. Votre soutien peut s’exprimer ici.

102 réponses à “FAUT-IL FERMER LA BOURSE ? PAS LA PEINE, LES ORDINATEURS S’EN CHARGENT !”

bien vu! mon esprit simplet m’inspire une maxime « Grouchienne »

» Pour produire une véritable catastrophe, taille XXL il faut deux choses: un polytechnicien balèze en maths, et surtout l’installer devant un ordinateur… »

Ce que la lutte des classes n’a pu obtenir, la baisse tendancielle du taux de profit, les algorithmes l’ont fait!

PS: votre programme, auquel j’adhère, bien évidemment, résumé dans un autre sujet, est si radical et si synthétique, que j’ai failli, en réponse, mettre un lien sur le thème « c’est du brutal », version Tontons flingueurs ,évidemment!

trop de gloss tue le gloss

mais comparativement ça coûte combien un ensemble de traders pertes comprises ?

On dirait une fable, la perfection du résultat des réactions programmées …aboutit au néant !

C’est même, pour moi « moral ».

Aspect immoral, à régler, l’humain qui a besoin de travailler pour se loger et se nourrir doit être privilégié, ou à minima protégé, par rapport à ces expériences de tentatives de profits maxima !

La technologie au secours de cette baisse:

http://www.telegraph.co.uk/technology/news/8753784/The-300m-cable-that-will-save-traders-milliseconds.html

Ou comment en économisant quelques millisecondes dans les temps de transaction transatlantique on peut espérer gagner des millions de $ ou de £ !

rien compris à ce gribouillage coloré …

mais ne peut-on s’enrichir même à la baisse et notamment avec des options négociables qui rapportent plus que de miser sur de simples fondamentaux économiques ?

A la baisse, à la hausse, tout ce que vous voulez, mais le problème est que pour gagner quelque chose, il faut apparemment dépenser de plus en plus (le coût des transactions avortées…)

est-ce une création de valeur ajoutée … ? « m’enfin » (faire de la commission + frais facturables)

en tout cas c’est faire n’importe quoi en limitant les risques, comme un coït interruptus…

Dans ce cas, je suis prêt à faire n’importe quoi 😉

@Karluss

Patience, le désordre continu de s’organiser.

Futur courbe du Nanex ci-dessous compréhensible par tous.

_______________________________________________________________________________

EEG plat =) débrancher la machine …

la c’est la fibrillation, c’est pas bon signe non plus

Edifiant !

Est-ce du plus au krach qui se profile ou à l’évolution des 4 dernières années au niveau technologique ? La puissance des ordinateurs a double depuis 3 ans, donc on peut déjà imputer 100% de l’augmentation disons depuis 2008 a la technologie, ca fait environ 20 x 2 = 40, on est encore loin du 60 apparent d’aujourd’hui. C’est un bon graphique qui montre que depuis 2007 rien n’a été résolu.

Pourquoi faudrait-il « résoudre », Danolo?

Laissons au contraire les moyens suivrent leur évolution. Le mouvement exponnentiel est maintenant compris par les non-initiés.

Peur pour son « capital »…???

Je n’ai jamais misé un centime en bourse, vous etes a coté de la plaque.

Simplement j’éssaye d’analyser cette courbe sans dire de bétises.

L’évolution depuis 2007 n’est pas exponentielle. En plus la vitesse de calcul des ordinateurs doit etre prise en compte dans l’analyse, ce qui probablement vous échappe.

Danolo : la vitesse théorique des machines est exponentielle : Vous parlez par définition des unités de calcul : du processeur ! Mais une machine n’est pas seulement le processeur.

C’est une belle idée marketing des fabricants de processeurs pour vendre mais a crée une confusion chez beaucoup de gens.

Il est vrai que la vitesse de calcul augmente suivant la fameuse loi moore mais la compléxité aussi et donc les différents composants ont de plus en plus tendance à présenter des seuils et des goulets d’étranglements.

De plus beaucoup de technologies réseaux ne vont pas à la même vitesse que la puissance de calcul.

Regardez autour de vous ! est-ce que votre connexion internet double tous les 18 mois…

Donc ce rouge(annee 2011) qui ce ballade de facon anarchique de haut en bas,c’est ce qu’ils appellent la volatilite?

promenade anarchique dans les hauteurs aériennes: volatile sans tête. Manque que les plumes,

ça viendra ( avec du goudron…).

» Il ne faut jamais rien faire pour le première fois. »

Les conservateurs vont être contents: n’y touchez pas, nos robots s’en chargent.

Un nouvel exemple que les réformateurs radicaux – fermer la bourse, saisir les banques etc…- sont des songes-creux.

[…] Faut-il fermer la bourse ? Pas la peine, les ordinateurs s'en chargent ! […]

Fermer les bourses, supprimer le prêt à intérêt sont des actes volontaires.

Espérer que le capitalisme va s’effondrer de lui-même sans se débattre, c’est attendre un miracle.

Que le capitalisme soit auto-destructeur, nous sommes quelques uns à le savoir, mais pour refuser d’être entraînés, il faut des actes délibérés.

Excellent timing Bernard.

Un mirage qui s écroule cela devint in miracle.C’est merveilleux, la réconciliation de 2 racines identiques, merveille. Ligne de mire; ligne droite imaginaire déterminée par l’œil du tireur. Le capitalisme et son seul alibi, la Libye par exemple, c’est son besoin de conquêtes, détruire pour construire d’une part et s’accaparer le sous sol de l’autre. Les images de la popularité locale pour ces 2 représentants de commerce sont magnifiques et magnifiés, c’est une révolution, un coup d’état organisé, la cerise sur le gâteau.

Tu nous fait du Dissonance, Marlowe.

« le capitalisme va s’effondrer de lui-même sans se débattre, c’est attendre un miracle. »

« Que le capitalisme soit auto-destructeur, nous sommes quelques uns à le savoir »

T’as pas l’impression d’un illogisme quelque part…??

un bonhomme avec une ceinture d’explosif est auto-destructeur, mais en général quand il part en sucette, il entraine bien du monde avec lui… Pour un tempérament auto-destructeur, c’est ça, se débattre.

Yvan,

Sois honnête quand tu cites une phrase, considère là dans son intégralité !

En effet, Marlowe. J’ai foiré.

En lisant trop vite, j’ai raté le début de la première et la fin de la deuxième.

Avoue que ces morceaux repris étaient antagonistes un peu quelque part.

Bon, sinon, des actes volontaires, je suis largement partant A CONDITION de ne pas se tromper de cible.

Je te dis ça, vieux, tout simplement à cause de la manipulation ambiante dont je connais la fourberie.

Et le pire, est qu’elle fonctionne sur un paquet de personnes…

Les machines prolongent l’agonie. Mais les bourses ont désormais quitté la réalité de la production et de la valeur. Jusqu’à la crise paroxystique. Le déclencheur sera la dissension politique. Nous y sommes ?

François Baroin, à la sortie de la grand messe: « nous ne sommes pas inquiets »

http://www.lefigaro.fr/flash-eco/2011/09/18/97002-20110918FILWWW00069-baroin-a-confiance-dans-les-banques.php

ça me fait penser au sketch de Coluche: » on dit que l’ ayatollah khomeiny est très malade…mais son entourage n’est pas inquiet…eh ben, nous non plus! »

La bicyclette de Jarry, peut, ÊTRE.

http://fr.wikipedia.org/wiki/Alfred_Jarry

Ca rappelle la surprise de certains au moment de la victoire d’un ordinateur sur l’humain aux échecs. Et les illuminés criant à l’intelligence artificielle…

Essayez avec le GO, on en reparle après.

Bon, sinon, ça rejoint aussi la théorie générale non pas de la Relativité, mais d’un « monde » qui s’autoclôt par lui-même tout seul en opposition de l’anneau Möbuisien.

Ce qui correspondrait parfaitement à la nécessité d’anti-protectionnisme obligatoire du réel.

Juste un « détail ».

Traiter 10 000 USD ne rend pas compte du profit fait…

Pour le go, des programmes comme MoGo ou Zen commencent à faire bouger les lignes ; 4ème dan sur le serveur de jeu en ligne KGS pour Zen cette année, cela commence à souffler fort.

Mais bon, le go, bien sûr, c’est plus compliqué que les échecs, mais comparé à traverser la rue sans se faire écraser ni marcher dans un crotte de chien tout en buvant un café et en répondant au téléphone, c’est de la gnognotte !

Pour votre remarque sur le profit apporté par le traitement des ordres, je la trouve extrêmement pertinente …

Finalement l’effet serait analogue à celui d’une taxe Tobin?

Il y a une semaine j’ai pris un jeune en stop…..

il voulait allé à Annecy. c’était aussi ma destination….

Il etait à nimes et faisait des études de « je nesaisplustropquoi mais ingénieur malgrétout » après avoir fait mathsup….

comme il était indécis sur ce qu’il voulait faire de sa vie, un de ses prof lui avait conseillé

je cite » puisque t’es bon en math tu peux faire des mathématiques financières »……

!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!

je vous dis pas… Il est tombé dans la bonne voiture….

Nimes-Annecy ça fait au moins 4h……

je lui ai dit d’aller faire un tour sur le site de jorion

Graphique joli mais trompeur car les trop nombreuses lignes sont opaques et embrouillées. Les plus anciennes sont masquées par les plus récentes (on devine un peu de bleu foncé dans les zones vides sous le bleu ciel, de vert sous le rouge…) Il faudrait utiliser des lignes transparentes en synthèse soustractive (CMY) ou alors en synthèse additive (RGB) avec fond noir. Ou encore, utiliser des moyennes sur des périodes plus longues pour réduire fortement le nombre de lignes.

@ Nanex, revoyez votre copie SVP.

Pour qui distingue les couleurs le graphique est tres clair. Sinon vous auriez du gris ou du noir partout. Changez de lunettes ami gastéropode, ou abandonnez la mauvaise foi.

Ou en résumé graphique, d’autres possibilités:

Carré blanc sur fond blanc de Kasimir Malevitch

Museum of Modern Art (MoMA), New York (1918)

http://www.oniraloin.com/oeuvre_1670.php

Broyeuse de chocolat duchampienne

http://portesurletoit.canalblog.com/archives/2007/02/11/3976676.html

fujisan,

Si la tendance dénoncée par nanex était infondée, les lignes supérieures seraient vraiment plus mélangées. Elles montrent beaucoup de rouge vers le haut. En plus, je suspecte la nanex d’avoir appliqué une superposition, plus c’est récent, plus c’est en avant et cache les autres.

Le rouge est nettement dans la partie supérieure et c’est ce qui est le plus récent. Le HFT est en action et envahit les marchés financiers.

Excusez-moi, je sais que ce n’est pas le sujet de l’article mais l’actualité se précipite. Et oui, même le dimanche. Le gouvernement grec tiendra cette après-midi une réunion en urgence qui n’était absolument pas prévue et cela quelques heures après l’annulation d’un voyage du Premier ministre grec à New York. Des économistes évoquent une réunion afin de préparer l’annonce d’une faillite imminente de la Grèce. Et pendant ce temps notre ministre François Baroin vient de se livrer ce matin à son numéro préféré : « Tout va bien madame la marquise ».

J’ai l’impression que l’ordinateur de Wall Street est parent de Hal 9000…Le débrancher? Un grand pas pour l’Humanité…

Pourquoi croyez vous que l’on déserte l’ISS ?:)

Pas bien compris le commentaire suivant :

« En ordonnée, c’est-à-dire l’axe vertical, le nombre d’opérations nécessaires pour traiter l’équivalent de 10.000 $ ».

Ne serait-ce pas plutôt « En ordonnée, c’est-à-dire l’axe vertical, le nombre d’opérations …pour gagner … « .

Auquel cas ce serait très intéressant.

Je le comprends comme « le nombre d’ordres, achats ou vente + leur annulations, passés pour un ordre effectif de 10 000$ ».

Ce qu’il faut voir c’est que les ordis jouent entre eux, quasi exclusivement. C’est « le marché »…

Les ordis des différents concurrents affinent leurs programmes, mais comme c’est un jeu à somme nulle il y a de moins en moins à gagner.

Pensée pour le pigeon humain qui pense pouvoir placer ses économies à la bourse. Un jour même les entreprises ne voudront plus y mettre les pieds tellement c’est artificiel et volatile (donc dangereux).

Merci HP, la problématique du high frequency trading, des automates et des robots ne m’est pas complètement étrangère, mais les marges unitaires sur les opés sont très faibles (moins de 1 du mille), aussi, je confirme que la bonne formulation me semblerait devoir être pour GAGNER et non pour TRAITER l’équivalent de 10k$.

Oui, j’entrevois mais j’ai un peu de mal avec l’ordonnée moi aussi.

Ce nombre d’opération correspond à celles qui ont débouché sur une réelle transaction (et on agrège pour avoir des « pixels » 10 000 euros) ?

Dans ce cas, cela veut dire que les échanges se font sur de plus petites sommes, puisqu’il en faut plus pour faire 10000 euros

On au contraire, on voit s’ajouter les pseudo-transactions du HFT, qui « polluent » le système et sont comptabilisées d’une certaine façon comme ayant débouché (puisque le trader gagne quelque chose avec son algo à la fin…).

Enfin, bref, on peut se perdre entre « fait » et « à faire », et qui a compté quoi.

C’est toutefois clair que systémiquement, il y a plein d’essais qui consistent à se sonder les uns les autres, et à tenter de rejoindre ces 50% « entre algos », donc dans un espèce de vrombissement de ruche (autant d’ailes qui remontent que d’ailes qui redescendent chez nos amis les bourdons qui ventilent nos amies les abeilles dans les ruches)

La schizophrénie se généralise à ce que je vois !!

Si la constatation des faits se nomme désormais schizophrénie, alors, oui.

Fais de doux rêves, Richiou.

OUI entre ceux qui savent pourquoi et ceux qui savent comment, la confiance où la soumission n’est plus ce qu’elle était « baisse tendancieuse du taux de croyance et augmentation des taux de réalités inventés, c’est l’étau qui se resserre et qui se sert » c’est pas de Marx c’est de nous.

Ca rappelle plus un épisode des shadok que la terrifiante question: « Sarah Connor? ».

non, c’est à coté.:)

« La cavitation hydrodynamique détruit le rendement de l’hélice ou de la pompe. L’énergie n’est plus transformée en mouvement (par exemple), mais soit elle reste dans l’engin moteur (qui peut ne pas supporter de sortir ainsi des conditions normales de travail), soit elle est diffusée sous une forme incontrôlée et donc probablement nuisible ».

Ou encore pédaler dans la semoule.

Le pb avec Paul c’est qu’il prend ses désirs et ce genre de graphique pour une réalité !!

Décidemment , toujours beaucoup de méconnaissance des mécanismes boursiers techniques .

Un stage chez DetlaOne (Soc Gen ) vous permettrait-il un upgrade cher mr Jorion.?

PS : je crois d’ailleurs qu’un connaisseur sur la page des commentaires a suggéré a Paul Jorion de décortiquer les méthodes de la firme nanex (et surtout de bien les comprendre en premier lieu) avant de s’en faire le promoteur abusé et abuseur .

La vérité en bourse ne se contente pas de bons mots ; ça serait trop facile sinon d’etre riche !

Mais surtout ça ruinerait les traders .

la griffe de l’ennui.

Freddy, j’apprécie tout particulièrement ce genre de commentaire.

Merci cependant de vous étendre un peu sur le sujet afin d’éclairer notre imparfaite compréhension.

Bon alors, expliquez

Mon cher FREDDY, si vous avez quelque chose à nous communiquer, que ne le dites-vous ? Insinuer, c’est bien, dire c’est mieux. Allez-y, qu’est-ce qui vous dérange dans ces données de Nanex ? Qu’apprendra-t-on chez Delta One (Soc Gén) que l’affaire Kerviel ne nous a pas déjà appris ? Allez-y, déboutonnez-vous : nous sommes entre amis !

ah non alors, un trader déboutonné, je ne veux pas voir ça ! …

déjà Bouton-né, c’est pas terrible …

La finance vue comme une course cycliste.

Comme dans le Tour de France où le temps mis par le vainqueur à parcourir la boucle n’a pas d’importance en lui-même, la vitesse des échanges de la version électronique de la bourse ne change absolument rien!

La seule chose qui compte c’est d’aller plus vite que les autres.

Au delà du côté « shadokien » de l’évolution de la Bourse il faut encore reconna^tre que Paul Jorion a débusqué depuis longtemps les mystifications boursières, particulièrement les mécanismes qui permettent d’empêcher – en apparence – le krach.

N’oubliez pas de nous faire rêver, de ces rêves qui quand assez de rêveurs y rêvent, deviennent plus que des rêves…

@ Paul Jorion Vous avez décidé , différemment de F. Lordon , d’utiliser sans restriction tous les moyens à votre disposition ( blog , articles , livres , émissions de radio ou de télévision …) pour diffuser vos idées . Pourquoi ne feriez-vous pas une vidéo ? ……….( Je pense à l’impact qu’ont pu avoir des vidéos comme « Monsanto » par exemple ou « gasland » ou encore « inside job » .)

Réunion de Wroclaw : les grenouilles attendent un roi…

Après avoir prudemment annoncé qu’aucune décision importante n’était à attendre, les ministres européens des finances réunis à Wroclaw ce week end achèvent leur réunion dans une lamentable cacophonie ; alors que le défaut de la Grèce sur sa dette souveraine qui se profile maintenant dans quelques semaines menace de déclencher une crise dévastatrice dans le système bancaire européen, aucun progrès dans la mise en oeuvre du deuxième plan de sauvetage décidé en juillet dernier n’est à noter. Bien au contraire, les divergences entre les pays s’accentuent, le camp des pays sceptiques qui exigent maintenant des garanties semble gagner du terrain, alors que dans le même temps, les opinions publiques d’un nombre croissant de pays semblent déjà résignées à voir ce plan échouer. Couronnant le tout, le secrétaire d’état américain au trésor est venu prodiguer ses conseils éclairés, exhortant les européens à plus d’union et plus de rapidité dans la gestion de la crise.

Quand on regarde la responsabilité éminente des Etats Unis dans la crise de 2008 d’une part, et à plus long terme, dans le lent pourrissement du système monétaire international instauré à leur avantage à Breton Woods, force est de constater que :

– Les conseils sont assez mal venus de la part d’une fédération qui serait depuis longtemps déjà passée par la case banqueroute, si elle n’avait pas usé et abusé de l’exorbitant privilège dénoncé en son temps par le Général de Gaulle.

– On comprends bien qu’il n’y a plus plus guère que l’Europe, dans l’état de déconfiture politique et financière où elle se débat aujourd’hui, qui leur permette d’adopter la posture du donneur de leçons.

Aux divisions entre pays Européens, se seront donc ajoutées les divisions entre ce qu’il reste d’Europe et les Etats unis, témoignant à quel point nos pauvres politiques sont totalement dépassés par la situation, incapables de proposer aux peuples un projet alternatif qui remette la finance au service du public. Après avoir pendant des décennies, hurlé avec les ultralibéraux la ritournelle du “moins d’état, moins détat… plus de marché, plus de privé,…plus de concurrence, plus de concurrence”, nous voici rendu au bout de cette idéologie délétère.

Les médecins de Molière ont le nez sur le furoncle et professent doctement qu’il est urgent d’attendre. Repoussons à demain la purge des dettes, instaurons partout des politiques récessives, et, telles les grenouilles qui attendent un roi, attendons la mythique croissance qui nous sauvera tous.

L’impression que tout cela me donne est que le moment où la “M… frappe le ventilateur” approche très vite !

@Paul Jorion

Pouvez vous nous dire si cette tendance se poursuit ce qui peut se passer d’ici 1 à 2 ans ?

[…] Blog de Paul Jorion » FAUT-IL FERMER LA BOURSE ? PAS LA PEINE, LES ORDINATEURS S’EN CHA… […]

Heureusement qu’il y a des humains qui donnent à becqueter aux bécanes :

http://www.latribune.fr/bourse/20110916trib000649800/comment-les-banques-centrales-ont-dope-le-cac-40-en-2010.html

« La dernière en date remonte au 10 mai 2010, période où les marchés d’actions européennes, en pleine crise de la dette, évoluaient alors à des des plus bas annuels. Or, il ressort que l’intervention des banques centrales s’était traduite par un bond de plus de 12 % pour le CAC 40 en un mois. Plus globalement, on peut considérer que l’action concertée de mai 2010 constituait un signe avant-coureur des mesures d’assouplissement quantitatif proposées par la Fed fin août 2010, au travers du fameux QE2, qui avait alimenté un courant haussier jusqu’à la mi-février 2011. »

La seule chose que montre ce graphique c’est qu’il faut de + en + d’opérations pour traiter 10 000$. Cela montre que les ordinateurs sont devenus plus rapides et capable de traiter simultanément un nombre très élevé d’opérations…Les ordinateurs ont expulsés les humains de la bourse, ils ont pris le pouvoir ! C’est la seule conclusion qu’on peut tirer ! Mais derriere les ordinateurs il y a quand même ceux qui les programment et qui tirent les ficelles…La Bourse a cessé d’être un jeux de hazard pour devenir une science informatique accessible uniquement à quelques uns…Est ce la le motif de fermeture ?

Non justement! même les programmeurs sont à la ramasse à mon avis…la machine échappe aussi, notamment dans les usages imprévus qu’on peut en faire, à celui qui la conçoit et la fabrique. Ainsi le programmeur conçoit un programme et un logiciel mais une fois qu’ils sont lancés, il n’a plus grand chose à dire. Donc, personne ne maîtrise rien, même les traders sont agis à leur insu par une force qui les dépasse…soupçonner l’agissement de programmeurs derrière les ordinateurs est encore une façon commode de se rassurer en croyant que l’homme maîtrise le cours des choses…

Monsieur Jorion,

Je vois dans cette histoire l’aboutissement de l’idée que le Marché veille à la meilleure répartition possible des biens et des services. Il suffit de le laisser agir tout seul pour que tout le monde aille pour le mieux dans le meilleur des mondes.

Dans ce cadre, la seule chose possible est de connaître ses lois pour veiller à ce qu’il marche le mieux possible en spéculant avec énergie. Selon la théorie en vigueur, les spéculateurs veillent à ce que le Marché fonctionne de façon optimale en profitant de toutes ses imperfections pour se faire de l’argent. C’est le point de départ des vices privés et des vertus publiques.

Les traders HFT ont poussé cette logique jusqu’au bout. Mais ils ont renoncé à une hypothèse de base de la théorie classique. Ils savent que le Marché peut être manipulé, ne s’en privent pas et dégoutent les autres spéculateurs de jouer avec eux car les HFT ne respectent pas la croyance que le Marché ne se manipule pas.

Nos élites se retrouvent là avec un problème. Les HFT démontrent que le Marché financier se manipule. Interdire les HFT, c’est admettre que cette hérésie est possible et c’est aussi commettre l’autre grande hérésie qui consiste à réguler ce fameux Marché. Il en perdrait sa posture de dieu qui règle au mieux les rapports humains. Laisser aller, c’est donner à quelques acteurs tout le pouvoir sur toute notre société. Les propriétaires de ces ordinateurs deviennent encore plus puissants que ce que ce je peux imaginer. Le lien entre libéralisme et démocratie saute.

Ces ordinateurs sont l’aboutissement de la rationalité la plus pure. Ils sont l’aboutissement de la volonté de profiter de chaque faiblesse du marché. Ils sont l’aboutissement de l’idée que confier toutes nos relations au Marché est bon et qu’il ne peut absolument pas sortir du mal de ce pari.

Les HFT établissent que ce pari est perdu. Retour au politique et à la société. Sur quelle base ?

PS : Vous pourrez dire à Guy Sorman que l’Europe des marchands est aussi attaquée par les HFT.

[…] Blog de Paul Jorion » FAUT-IL FERMER LA BOURSE ? PAS LA PEINE, LES ORDINATEURS S’EN CHA… Source: http://www.pauljorion.com […]

@ Paul Jorion

Votre explication technique m’échappe ou, du moins, j’aimerais m’assurer de sa compréhension.

Pouvez-vous nous consacrer quelques minutes pour répondre (ou l’un de vos excellents blogueurs)?

Ce que je comprends de votre papier : il est de plus en plus difficile de gagner de l’argent en bourse. Par exemple, le nombre d’opérations (aller-retour?) nécessaire à un gain de 10.000 € devient considérable et coûteux, donc moins rentable. Ce n’est pas un hasard et ce n’est pas un phénomène isolé. Du coup, les investisseurs vont naturellement se détourner de la bourse.

Pourquoi coûteux ?

1) parce qu’il faut des ordinateurs chers et super puissants pour effectuer au mieux les arbitrages susceptibles de générer les gains espérés

2) parce qu’en période de baisse prolongée, les marges de manœuvre bénéficiaires se réduisent (le gâteau se réduit)

Autrement dit, la bourse redevient un simple lieu d’échange de titres où la spéculation n’a plus d’intérêt car trop coûteuse ?

Est-ce bien cela que vous nous dites ?

@ Thom

Il ne s’agit pas du nombre d’opérations pour un « gain » de 10.000 €, mais pour le traitement de 10.000 €, sur lesquels les gains réels seront infiniment plus petits.

Coûteux parce qu’il faut :

– les ingénieurs qui programment les bestioles informatiques ;

– les bestioles informatiques ;

– et surtout les emplacements (au plus près de la Bourse pour gagner quelques nano-secondes dans les transferts des ordres) et les câbles en fibre optique (dernier exemple en date le fameux câble à 300 millions de $) pour gagner aussi de précieuses nano-secondes.

Viendra le moment où l’investissement pour gagner 1 nano-seconde ne sera plus rentable par rapport à l’espérance de gain.

A l’image de toute la production capitaliste modernisée.

Merci, Julien, j’étais assez proche du mécanisme, ordre de grandeur des enjeux (10 K€) mis à part.

Finalement, c’est bien cela, il devient de plus en plus cher de gagner quoique ce soit à la bourse. Chercher à gagner une nano-seconde sur le voisin pour gagner plus que lui, avant lui, devient inaccessible au plus grand nombre. Demain, ce n’est pas d’un câble à 300 Millions $ dont on aura besoin mais à 3 milliards (comme l’homme qui les valait dans les années 70 🙂 )

Mais poursuivons le raisonnement, SVP.

Quelles sont les implications évidentes de ce phénomène mis en évidence ici ?

J’en vois au moins deux, mais merci de compléter si davantage.

1) Je crois comprendre que c’est la fin programmée de la bourse puisqu’elle est pipée, c’est bien ça ?

2) Comment se financer sur le marché quand on est une entreprise, alors ? Surtout si les banques ferment elles aussi le robinet ?

Juste une parenthèse sur les « nanosecondes. »

Les ordis à 3 GHz traitent l’info élementaire en 1 ns (en gros limite du temps d’accès mémoire), Par ailleurs, 1ns représente une propagation d’information sur 20 cm (vitesse de la lumière sur les fibres = 200 000 km/s). C’est aussi la taille des connections de la carte mère et ce n’est pas un hasard…

Je ne pense pas que qui que ce soit s’échine à gagner des nanosecondes en jouant sur 20 cm de câble, quand on a fait un peu de câblage d’immeuble, c’est désespéré.

L’échelle de temps du HFT, amha, est la milliseconde(*), et pour « gratter » dessus, on va effectivement y aller microseconde par par microseconde « s’il le faut » (200 m).

(*) c’est le temps qu’il faut pour transmettre tout un paquet d’info, car l’info est empaquetés N fois entre la mémoire et le transit sur la fibre, avec 7 couches dont la couche physique n’est que la première. La taille d’un paquet typique doit être quelques kOctets, soit 100 kbits, ce qui, même sur une ligne à 10 Gb/s purement dédiée, prend 10 microsecondes. Je doute qu’une transaction puisse être codée sur un seul paquet ne pour des raisons de sécurité (cryptage ?), donc il faut au moins 50 microsecondes de temps de fibre disponible pour transmettre, et avant et après, les ordis des deux bords doivent mettre à jour d’importants fichiers, la fibre prend quelques km si la banque est pas trop loin de la bourse, donc quelques dizaines de microsecondes là aussi. Mis bout à bout, on taquine la fraction de milliseconde dans ce cas optimiste.

La « nanoseconde », c’est un peu pour la frime, comme si le processeur décidait de jouer au casino à chaque coup d’horloge (3 GHz).

@ Timiota

Merci, ô Vénérable Timiota, pour ces explications techniques mais fort intéressantes.

Ainsi – on s’en doutait – c’est tout autant la distance que le volume de transactions (aller-retour) simultané qui permet de générer quelques mini-bénéfices. Tout cela mit bout à bout finit par faire du profit… quand on est le seul à le faire !! Lorsque cela devient « monnaie » courante, cela ne rapporte plus rien puisque tout le monde fait pareil, avec la même vitesse. CQFD.

@timiota

Si les agents en question utilisent des réseaux de type Internet, alors il ne s’agit pas d’une architecture en 7 couches commes vous dites mais plutôt en 4 couches.

La taille d’un paquet dépend, à part des données en soi, du nombre de couches à traverser (chaque couche encapsule son en-tête dans le paquet) et de la MTU (maximum transmission unit) du réseau. Sur ce genre de réseau dédié, la MTU doit être plus élevée que la normale et donc, le taux de fragmentation des paquets doit être plus petit que celui qui a cours sur l’internet, ce qui va aussi accélérer le taux de leur transfert.

Merci Eric

Je voulais en effet lancer le débat plutot que de prétendre à l’exactitude. La dernière fois que j’ai compris tout d’une transmission, depuis le langage machine et l’oscilloscope jusqu’au résultat, c’était du temps du 6502 8 bit qqs MHz. Depuis, j’ai suivi quelques morceaux, mais pas du tout le détail, … imaginez ce que je pense de Bill Gates quand, en plus, Windows rajoute ses caprices sur les N couches du réseau.

En revanche, côté vitesse de la lumière dans la fibre ou de l’info électromagnétique dans le câble, je n’ai guère de doute sur les chiffres que j’ai avancés.

Pour fantasmer un peu, ces gens qui vont s’envoyer des paquets d’infos entre eux pour espérer grapiller quelque chose, ça rapelle les modèles de physiques les plus fous, ou pleins de choses un peu aléatoires fournissent quand même une propriété émergente « forte ». Lee Smolin (l’auteur de « The trouble with physics ») s’amuse par exemple à faire ressortir la mécanique quantique des fluctuations stochastiques d’un ensemble de choses qui n’est plus quantique que ça en lui-même.

(Ne m’en demandez pas plus)

De rien timiota!

Dans les transmissions, je me débrouille bien car je suis encore à l’université et les réseaux sont ma spécialité (niveau master). Mais à la mécanique quantique je ne touche pas, j’apprends sur le tas et , par exemple, j’ai grand mal à suivre la formulation hamiltonienne du principe de variation statistique dans l’étude que vous proposez dans le lien.

Pour le reste, oui les chiffres sur les vitesses de transmissions sont correctes. Comme la vitesse est un facteur très important dans ces réseaux, ils peuvent aussi jouer sur le routage : leurs réseaux ne sont pas très vastes, après peu de temps d’expérimentations ils pourront très facilement fixer des routes statiques pour les paquets et leurs applications s’épargneront d’exécuter Dijkstra et autres algorithmes de routage, glanant ainsi quelques millisecondes. Bref, il y a un large évantail d’optimisations faisables sur la vitesse.

Merci pour toutes vos interventions, parfois c’est hardu mais c’est très stimulant.

Je crois que les gouvernements européens et la BCE ont bien compris ce jeu de bandit manchot automatique. C’est à mon avis ce qui motive leur « indécision » dans l’affaire grecque. Ils laissent jouer les automates entre eux hors de notre appréhension temporelle et certains que la règle de l’ »optimisme forcé » fera office de « main invisible ».

Les suédois pas content des manipulations de la bourse, où ils ont investi leurs retraites :

http://lecercle.lesechos.fr/node/37741

Où l’on vérifie que le capital tient les salariés retraités ou futurs retraités , par les bourses ….

Sarah Connors avait raison. SkyNet existe. Le 21 décembre 2012 il entrera en phase ultime et les machines prendront le pouvoir …. A lire cet article c’est cette image qui m’est venue instantanément à l’esprit…. Finalement Terminator est un film prédictif… (désolé de cette intrusion….)

J’ai pas du tout comprendre car un ordre non exécuté ne coute rien. De même que l’annulation d’un ordre. Donc qu’il faille 80 opérations pour traiter 10.000 euros ou seulement 10 je ne vois pas ce que ça change

@ Joel

Il ne s’agit pas de la passation des ordres mais bien de la capacité à passer les ordres pour qu’ils rapportent de l’argent.

Graphique édifiant!

High Frequency Trading : Il va tuer la bourse comme le spam tue les emails

http://www.agoravox.fr/actualites/economie/article/high-frequency-trading-il-va-tuer-100958

Note : Lecteur audio en haut du texte.

Monsieur Jorion.

Ca m’étonnerait que vous ayez 5 minutes ces temps-ci, mais il serait peut-être utile de commencer par les bases de l’agrégation d’ « actifs ».

Je préfère ainsi déjà le terme agrégation à celui de synthétique. C’est plus parlant.

Et les lettrés pourraient se rendre compte qu’ils utilisent les maths dans le langage maternel et comprendre des mots comme base, variation, incertitude qui sont les fondamentaux des « produits » financiers les plus complexes. Y’a rien de trop sorcier là-dedans.

Un exemple de base que chacun pourra comprendre avant de sauter à l’étape supérieure.

J’ai une relation commerciale de longue durée avec quelqu’un.

Je ne connais évidemment pas l’avenir car je n’ai pas de boule de cristal.

Imaginons qu’au moment où je veux travailler avec lui, je décide que pour le bien de notre relation, il est nécessaire de prévoir les évolutions obligatoires des prix et nous décidons, conjointement d’une formule qui permettra de modifier ce prix en fonction du contexte extérieur à notre relation.

Car NOUS savons que cet extérieur influera sur notre relation mais que nous n’aurons aucun pouvoir sur lui.

Très bien. Le contexte est décrit.

Je passe donc une commande à un sous-traitant admettons un tuyauteur (les transferts de fluide sont beaucoup plus fréquents que vous ne le pensez) . Et nous savons que le coût global de sa fourniture/prestation devra être quantifié selon le poids de chaque variation dans chaque type de coût.

Ainsi, je quantifie :

10% de sa fourniture est fonction du prix du cuivre.

70% de sa fourniture est fonction du prix de la main-d’oeuvre qu’il emploie.

20% de sa fourniture varie en fonction d’un cours de monnaie car nous ne sommes pas du même pays. (ça arrive même aux gens biens)

Le prix à un an pourrait ressembler à ça :

P an+1 = (delta cuivre*10 + delta MO*70 + delta risque de change*20)/100

le delta est bien évidement la différence entre le prix au jour d’entrée en vigueur de la formule et celui un an plus tard.

Là, nous avons maitrisé la base et UNE partie de la variation.

Pour maîtriser la totalité de la variation ainsi que l’incertitude, il sera nécessaire de fixer des bornes pour limiter ces dernières de façon volontaire et conjointe.

Si certains sont intéressés par la suite, faites-moi un lien vers ce sujet, et je continue dans les explications.

N.B. : il est nécessaire de passer par les bases de la gestion pour aller plus loin dans les « produits » bancaires.

Yvan, tu devrais lire ce que Pierre Sarton du Jonchay écrit sur la « prime » !

Julien. Je ne fais certainement pas du prime (time). Mais où as-tu vu le concept de « prime » dans mes écrits…??

Tu me sembles déformé par le risque, toi.

Là, je fais un commencement en limitant, au contraire, le risque.

Comme font les banquiers à LEUR avantage.

Si tu ne vois pas le lien Yvan, c’est bien qu’il faut que tu lises la prose de Pierre 😉

Et ce que Julien Alexandre en pense .

@ Juan

J’en pense beaucoup de bien. J’estime simplement qu’il y a un phasage nécessaire et que la priorité est à la résorption des inégalités dans les rapports de force. Pour le dire autrement, avant d’introduire la complexité de la prime, il faut simplifier le système par l’autre bout afin qu’il puisse digérer le fonctionnement de la prime.

Julien, en effet. Il y a phasage.

Et ce que tu appelles prime apparaitra naturellement lorsque je démontrerai l’inverse du but de la relation de longue durée que j’expose.

Car ici, il s’agit d’équilibre recherché. Chose beaucoup plus compréhensible au départ.

(j’appelle bénéfice ce que tu appelles prime, en fait)(bénéfice augmenté par le déséquilibre, bien sûr)

@ Yvan

Content que tu vois (enfin) le lien. Raconte pas que des bêtises le modo 😉

Bref, on attend la suite de ton raisonnement avec impatience.

Oui, Julien. Mais toi, tu connais tout ça.

C’est le reste du on qui peut être demandeur. Sans vouloir me faire prier, car je m’en fous.

Si je bosse pour des prunes, autant que je m’occupe à autre chose.

Ce qui est publié ici l’est rarement « pour des prunes » !

Bon, déjà, dans un premier temps, je vais transférer mon premier commentaire dans le sujet des ETF, qui est plus récent, et ajouter le principe du bornage car la variation et son contrôle par le degré d’incertitude permettra aussi de comprendre le pouvoir dégueulasse des sociétés de « capital risk ». Puisque tu aimes le risque et je vais même te parler de son transfert.

Le transfert de risque, Pierrot en parle…???

Ca m’étonnerait…

@ Yvan,

Bonsoir,

Le cours du professeur philippe jorion,

http://merage.uci.edu/~jorion/papers%5CRiskMgtCreditCrisis.pdf

http://merage.uci.edu/~jorion/

Un exposé sur différents modèles de risques adoptés et réflexions autour d’exemples concrets, un tableau corrélant directement les type de « management / gouvernance » dans les entreprises considérées avec les pertes subies récemment…

Noir désir Nous n’avons fait que fuir….

http://www.youtube.com/watch?v=WcY5tzcuD1c&NR=1

Merci, Jérôme.

J’allais aborder le sujet AIG dans le commentaire suivant, justement.

Et l’explication de la politique de GS montre bien aussi le degré d’ignominie du système. Qui se tue lui-même, d’ailleurs, en pensant contrôler la nature. Pour eux, le monde.

[…] jQuery("#errors*").hide(); window.location= data.themeInternalUrl; } }); } http://www.pauljorion.com – Today, 6:03 […]

[…] en train de tuer la finance ? C’est en tout cas la thèse de Paul Jorion, qui disait dans un article récent : « À la Bourse de New York, ces jours-ci, la loi de la baisse tendancielle du taux de profit […]

[…] en train de tuer la finance ? C’est en tout cas la thèse de Paul Jorion, qui disait dans un article récent : « À la Bourse de New York, ces jours-ci, la loi de la baisse tendancielle du taux de profit […]