Ouvert aux commentaires.

Il se confirme depuis peu de jours que la certification du Boeing 737Max et de son système MCAS (celui qui a probablement pris le contrôle de façon aberrante en suivant un capteur erroné) est sujette à caution. Une partie de la certification est faite par … Boeing lui-même, habitude prise depuis de longues décennies pour ce qui ne semble pas critique, la FAA (autorité américaine) aimant quand même encore voir les gros morceaux elle-même. Dans le cas d’espèce, comme on peut le lire dans cet article du Seattle Times, des modifications lourdes ont été appliquées entre la certification (sur dossier) et la version livrée, suite aux essais en vol, en estimant néanmoins qu’on pouvait ne pas parler de tout cela aux pilotes.

On est là assez clairement dans le passage des limites. De quelles limites précisément ?

Le principe de robustesse de design est basé essentiellement sur le dyptique « la probabilité de panne du morceau » < factorisé par> « les conséquences de la panne ». Il faut évidemment un arbre, pour faire monter les conséquences vers le haut, depuis mettons un capteur jusqu’à la centrale d’inertie, puis à l’avion tout entier. Je vais prendre les choses à l’envers de l’ordre consacré pour ces choses là en ingénierie, dont le nom est FEMA (Failure Mode and Effects Analysis), page wiki sans Version Française (mais basque oui), et je vous passe le niveau un peu plus systémique de « Failure mode, effects and criticality analysis (FMECA) ».

Le tableau essentiel est celui-ci :

| Sévérité –> Probabilité | I | II | III | IV (Hazardous ?) | V (Critical) | VI (Catastrophic) |

| A | Low | Low | Low | Low | Moderate | High |

| B | Low | Low | Low | Moderate | High | Unacceptable |

| C | Low | Low | Moderate | Moderate | High | Unacceptable |

| D | Low | Moderate | Moderate | High | Unacceptable | Unacceptable |

| E | Moderate | Moderate | High | Unacceptable | Unacceptable | Unacceptable |

C’est un mix de probabilité (de A=quasi-inimaginable à E=Fréquent) et de gravité (de I = sans effet à V = critique, VI = catastrophique). Et il ne faut pas franchir s’aventurer trop loin dans la ligne oblique « Moderate », ne pas aller à « High ».

Ah oui, le « Catastrophique », c’est la perte de passagers (ou de charge transportée d’une valeur de 1 Million de $). Mais à la limite la perte du gros de l’avion (le fuselage, « the hull ») sans tuer les gens, c’est pas trop grave. C’est le cas de l’amerrissage du capitaine Sullenberger sur l’Hudson pour le vol US Airways 1549 (un Airbus A 320) par exemple. « Critique », vous risquez de blesser des passagers, 1 mort maxi (mauvaise réponse à une méga turbulence et vous volez au plafond, décompression mais l’oxygène est là etc.).

On a deux ou trois autres choses qu’on rajoute : quel est le délai avant qu’on se rende compte de la panne (bout d’aile cassée : c’est tout de suite ; fuitouille d’huile : à la révision de la semaine ou des deux mois).

Toujours est-il qu’il est tentant de rétrograder d’un cran (de droite à gauche et/ou de bas en haut) une panne donnée. Et il semble que la non redondance dans l’analyse des capteurs (apparemment le cas du MCAS du Boeing 737 Max, dont le correcteur se basait sur un seul capteur et ne tiquait pas si ce capteur déconnait même au sol) aurait dû le mettre dans « High » et V ou VI, alors que cela a terminé dans Moderate et IV ou V (schématiquement, car ces notions sont renumérotée dans le vrai standard en usage : ARP4754 et ARP4761 ).

On pourra se rappeler que la tentation de minimiser les risques dans la finance est sensiblement mue par les mêmes ressorts, faisant fi de toute ’’philia’’ me dit Aristote dans mon oreillette : profiter cupidement des opportunités en se disant que « pour l’instant tout va bien ». Notamment parce que les supposés régulateurs se sont arrangés soit pour être payés par les fauteurs (audit) soit, lorsqu’ils sont dans le service officiel de contrôle (SEC aux USA, COB en France), pour être un peu leurs copains quand même. Et en cas d’accident « catastrophique » (Crise de 2008 /Crash du Lion air, pour filer l’analogie) ne pas trop changer les choses, se contenter d’une brève formation supplémentaire pour dire qu’il y a un petit quelque chose de nouveau, un peu comme la loi Dodd-Frank s’est contentée d’un ménage fort modeste dans les pratiques des investisseurs et des banques. Et un peu comme en France on autorise toujours les paris (options purement spéculatives) depuis la levée de leur interdiction en 1885 ; (« l’exception de jeu » : Le Code pénal, dans son article 421 réprimait d’une amende et d’une peine de prison tout parieur qui aurait effectué un pari sur un ‘effet public’).

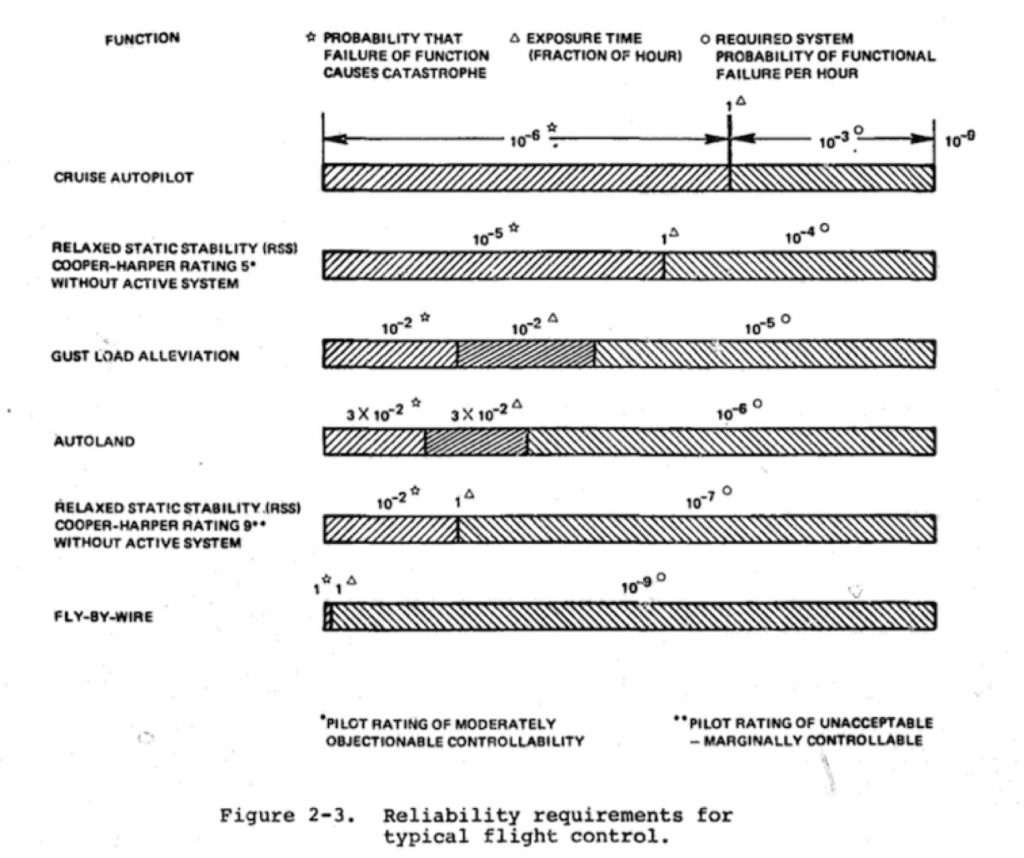

Nous allons finir par une déclinaison un peu plus concrète à titre d’exemple. Tout d’abord on rappelle que le standard de panne est de 1 pour 1 milliard d’heures de vol (10^-9 d’occurrence pour 1), ce qui, comme je l’ai expliqué l’autre jour, correspond à moins d’une panne sur une très grosse flotte (>3000 avions) sur 30 ans. L’exemple ci-dessous tiré de What are the design parameters for airliner safety ? explique un peu mieux comment on décompose cette probabilité de 10^-9 en pratique, du fait qu’on se réfère à un vol moyen un peu idéalisé : la probabilité de panne est le premier segment, la fraction de temps où le système étudié est censé servir est le second segment. En dessous (en anglais) l’explication pour le pilote auto (Cruise autopilot) et le Autoland (atterissage auto) :

If we take the cruise autopilot as an example:

- When it fails, it just means that the pilot will hand-fly the aircraft, and the probability of its failure causing a catastrophe is set to one in a million flying hours. Pretty remote.

- During cruise, the autopilot is on all the time. Exposure is pretty close to 100% (= 1)

- That requires the cruise autopilot system to have a reliability of 1 failure per thousand flying hours.

The reliability demand is for system functionality, including sensors, processors, electronics, power supply etc. One way to meet functionality demand is to duplicate the system, so that if one system fails, one or more remaining systems will still carry out the function.

Not really necessary for the cruise autopilot 10 ^ -3 demand, but for instance the auto land system must be 1000 times more reliable: it is only functional during landing, but the probability of function loss causing a catastrophe during landing can be quite high due to proximity of the ground and very short reaction times. That is why the CAT III auto land systems are up to triple redundant – the complete system is duplicated three times – if we only need one functional system and we have three, the functionality failure rate is f(sys)^3 (au cube). Each individual system can then have a failure rate of 10^-2 per flight hour.

To put these numbers into perspective: the average B777 now flies 12 hours per day, that is 4,380 hours per year. It would have to fly for 228,000 years in order to experience a catastrophic failure with a chance of 1 per 10^-9 flying hours.

Au total, il y a dû y avoir deux trous dans la raquette : l’un est dû à la recherche du profit, raccourcir les temps, internaliser les revues critiques et les audits et donc les certifications elles-mêmes, mais cela en soi n’aurait pas suffi à mon avis tant les réflexes sur la redondance sont bien établis dans ce monde là. Sans doute est-il significatif qu’il n’y ait pas eu de réaction suffisante suite au crash Lion Air en novembre. Cela milite pour l’ajout d’un autre trou dans la raquette, plus « cognitif ». La modification très à la hausse de la marge de correction du système MCAS (de 0,6° à 2,5° d’angle de l’aileron arrière) est intervenue lors des essais en vol et après la certification, ainsi que d’autres paramètres déplacés dans le même sens.

Les pilotes d’essai savaient-il que la chaine MCAS reposait sur un seul capteur d’incidence ?

Avait-on un simulateur de panne (du genre un avion au sol dont les capteurs sont « filoutés » pour faire croire qu’il vole) pour sonder les effets réels et valider les fiches de risque ? Là encore, l’analogie avec la finance est révélatrice de la mauvaise conception des stress tests dès lors qu’ils sont conçus en se tenant à distance des vrais effets, de la vraie volatilité etc. En bref, Boeing semble avoir réussi avec le 737Max le premier avion à système de vol ‘subprime’.

Laisser un commentaire