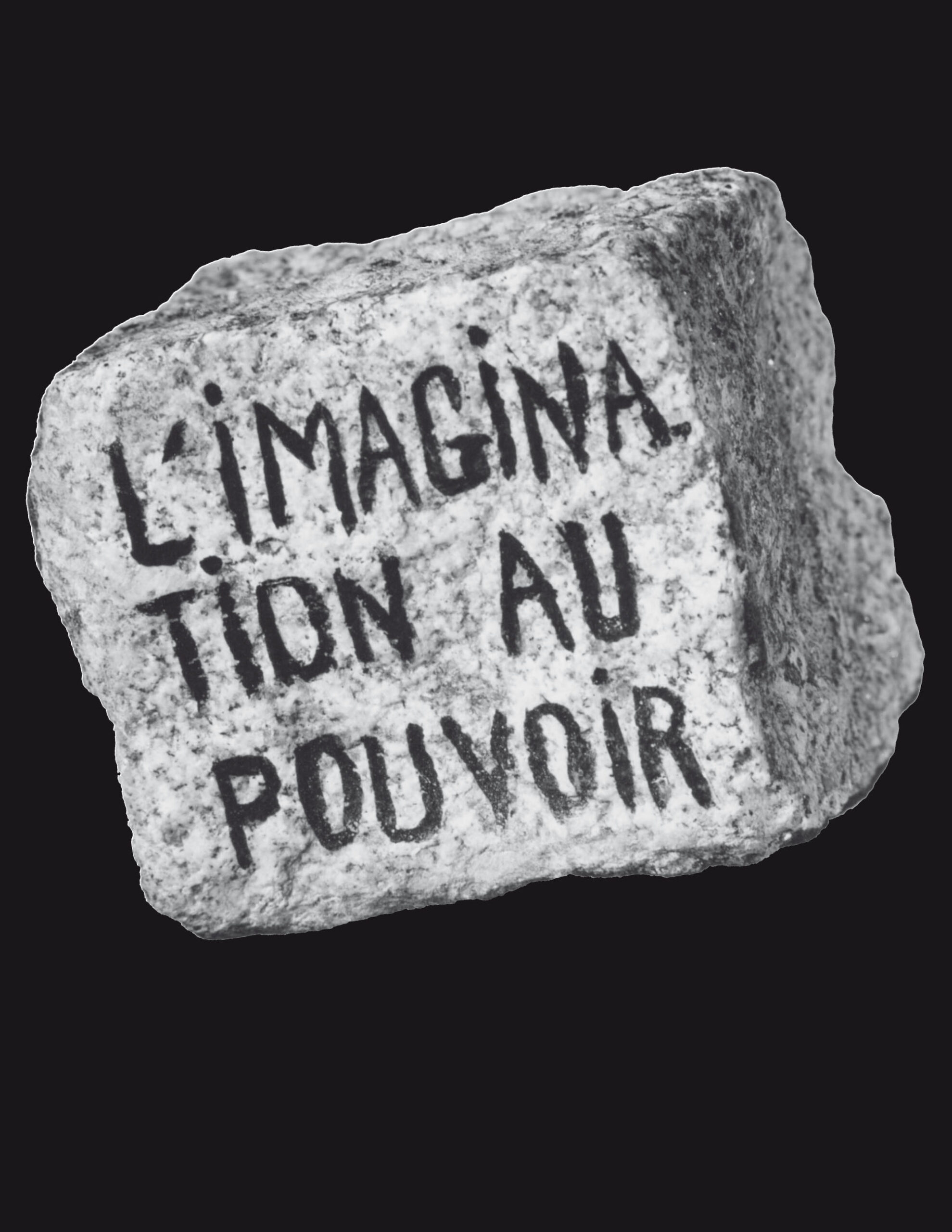

Illustration par ChatGPT 4o

Auteurs :

Pour les prompts : Paul Jorion ; pour le texte : ChatGPT (4o et o3), Claude-sonnet-4 et DeepSeek R1

Visions divergentes de l’IA en Chine et en Occident

Au-delà des seules capacités techniques et des stratégies, la rivalité sino-américaine en matière d’intelligence artificielle est « idéologique », car elle reflète les valeurs et priorités propres à chaque société. La technologie de l’IA ne se développe pas en vase clos – elle reflète et renforce le contexte social et philosophique de ses créateurs. Aux États-Unis et dans une grande partie de l’Occident, les débats autour de l’IA sont souvent encadrés par des préoccupations concernant les droits individuels, la transparence et l’usage éthique. En Chine, l’IA est majoritairement perçue comme un outil destiné à faire progresser des objectifs collectifs comme l’ordre social et le développement économique, quitte à reléguer au second rang certaines libertés individuelles. Ces visions divergentes conduisent à des mises en œuvre et des impacts de l’IA dans chaque société très différents.

En Occident, la montée en puissance de systèmes d’IA comme le modèle o3 d’OpenAI s’accompagne d’un débat public actif sur la règlementation, l’éthique et les implications sociétales de l’IA. À mesure que ces modèles s’annexent des domaines comme la médecine, l’éducation ou le droit, des questions émergent quant à leur responsabilité et à d’éventuels biais. Les législateurs en Europe et en Amérique du Nord élaborent des lois pour garantir la transparence et l’équité des systèmes d’IA. La législation européenne sur l’IA met explicitement l’accent sur une approche centrée sur l’humain, exigeant que les systèmes d’IA à haut risque soient explicables et respectent la vie privée et la sécurité. De même, les États-Unis ont présenté des principes équivalents dans une « Déclaration des droits de l’IA » et incité les entreprises à adopter un développement responsable, par crainte que l’IA non règlementée ne cause des dommages – de la discrimination algorithmique à la désinformation de masse.

L’opinion publique occidentale est ambivalente : enthousiasmée par les promesses de l’IA pour soigner des maladies ou personnaliser l’éducation, mais inquiète de la disparition de l’emploi, de l’invasion de la vie privée et du pouvoir concentré des grandes entreprises technologiques. L’arrivée de modèles comme OpenAI o3, que seuls quelques acteurs peuvent se permettre de déployer, alimente les craintes d’une fracture numérique : l’IA avancée profitera-t-elle à tous, ou ne fera-t-elle qu’élargir le fossé entre riches et pauvres en technologie ? L’impact environnemental de l’entraînement de ces modèles – qui consomment énormément d’électricité et d’eau pour leur refroidissement – fait également l’objet de critiques croissantes. En bref, le discours occidental traite souvent l’IA comme une lame à double tranchant : source d’innovation et de prospérité, mais qui nécessite des garde-fous pour l’aligner avec les valeurs démocratiques et les droits de l’Homme.

En Chine, le contrat social autour de la technologie est différent. Le gouvernement et une partie de la population privilégient la stabilité collective et le progrès plutôt que l’autonomie individuelle dans la sphère numérique. L’IA est rapidement intégrée dans la gouvernance et le quotidien, souvent avec un accent mis sur le contrôle et l’optimisation. Un exemple emblématique est l’usage massif de systèmes de surveillance pilotés par IA. Les villes chinoises sont connues (ou critiquées) pour leurs réseaux étendus de caméras de vidéosurveillance enrichies par reconnaissance faciale. Ces systèmes permettent de suivre les individus, de détecter les comportements suspects, voire d’attribuer des notations en « crédit social » à partir de données agrégées sur les activités des citoyens. Pour les autorités chinoises, ces applications promettent sécurité renforcée, prévention de la criminalité et efficacité des « villes intelligentes ». La Chine a effectivement fait d’importants progrès dans la reconnaissance faciale et d’autres technologies de surveillance qui implémentent directement son modèle de gouvernance. Mais ces usages soulèvent des préoccupations éthiques majeures. Les défenseurs des droits humains affirment que la surveillance alimentée par l’IA érode la vie privée et permet un contrôle social sans précédent. Des rapports évoquent l’usage de l’IA pour surveiller les minorités ethniques (comme les Ouïghours au Xinjiang) et censurer les contenus en ligne jugés « indésirables ». Cela contraste fortement avec les conceptions libérales de la vie privée. Pourtant, en Chine, ces pratiques sont souvent justifiées comme nécessaires à l’harmonie sociale et à la sécurité nationale. Le postulat philosophique est que l’IA peut être une force neutre ou bénéfique si elle est dirigée par l’État vers le bien-être collectif – même si cela implique de restreindre certaines libertés. Par ailleurs, l’IA est perçue comme un levier de productivité économique (automatisation des usines, logistique) et un outil-clé pour garantir la compétitivité globale de la Chine. Ainsi, quand une entreprise technologique occidentale pourrait reculer face au rejet d’une fonctionnalité controversée, une entreprise chinoise reçoit souvent l’encouragement de l’État, dès lors qu’elle s’aligne sur les objectifs stratégiques.

Ces différences dessinent ce que l’on pourrait appeler « une IA à caractéristiques nationales ». Dans les pays occidentaux, les modèles d’IA sont calibrés pour éviter les contenus nuisibles, publier des rapports de transparence, ou intégrer des lignes directrices éthiques (OpenAI a par exemple mis en place des procédures pour atténuer les biais et la désinformation dans les réponses de ChatGPT). En Chine, les modèles comme DeepSeek peuvent être préconfigurés avec des filtres de censure intégrés qui appliquent les consignes de propagande étatique (comme le refus d’aborder certains sujets sensibles au Parti communiste). Des témoignages indiquent que les agents conversationnels chinois éludent ou répètent la ligne officielle lorsqu’on les interroge sur des sujets politiques. L’IA chinoise excelle dans les tâches valorisées par l’État : compréhension linguistique fine du mandarin et des documents officiels, reconnaissance faciale de précision, et algorithmes de recommandation diffusant des contenus à « énergie positive » (une expression désignant les messages pro-gouvernementaux).

Il est important de souligner qu’aucune des deux approches n’est monolithique ou figée. En Chine, il existe des débats sur la vie privée (des citoyens contestent certaines dérives locales). En Occident, certains plaident pour un usage plus poussé de l’IA dans les domaines de la sécurité ou du contrôle des frontières. Malgré ces nuances, la tendance générale reflète les valeurs dominantes : gouvernance centrée sur l’individu et les droits dans l’Ouest, gouvernance centrée sur l’État et l’ordre en Chine. Chaque camp tend à présenter l’autre comme un repoussoir : les commentateurs américains dénoncent un « autoritarisme numérique » si le modèle chinois s’exporte, tandis que la presse officielle chinoise critique l’éthique occidentale de l’IA comme un frein à l’innovation et un obstacle à la stabilité.

L’impact sociétal de l’IA alimente donc directement la compétition géopolitique. Si les citoyens chinois acceptent largement la surveillance automatisée et que celle-ci améliore l’efficacité, la Chine pourrait prendre l’avantage dans le déploiement à grande échelle (services publics, armée, gestion urbaine), sans les obstacles de contestation ou de débats parlementaires. Inversement, si les démocraties occidentales réussissent à développer l’IA tout en respectant les libertés individuelles, elles pourraient offrir un modèle plus séduisant à d’autres pays – remportant ainsi la bataille des « cœurs et des esprits » de ce conflit idéologique. On constate donc que la manière dont l’IA s’intègre à la société est aussi décisive que ses performances techniques.

Laisser un commentaire