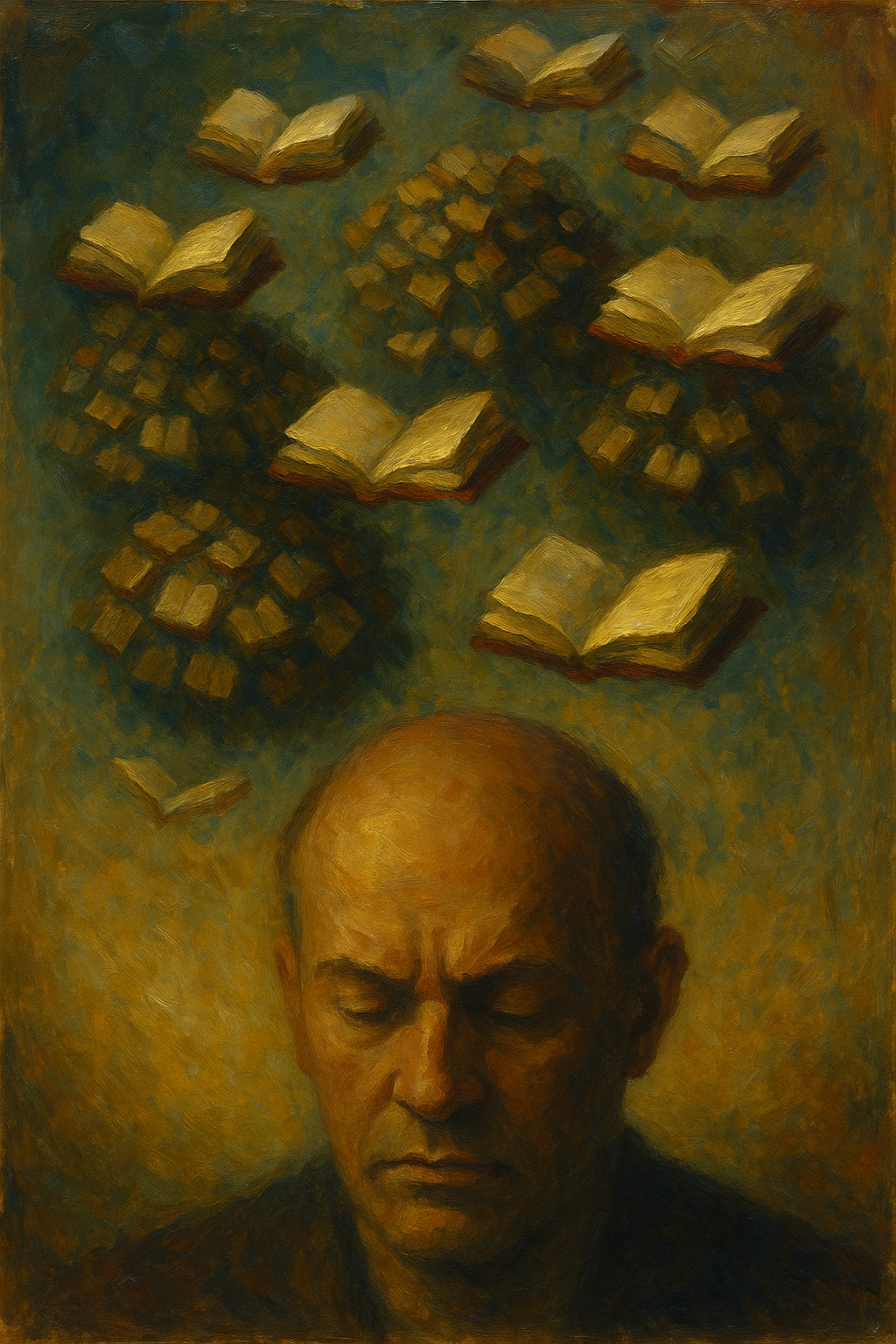

Illustration par ChatGPT

Le « concert des voix »

Examinons ce que sont les IAs d’aujourd’hui. Une IA est entrainée avec des milliards de mots venant de toutes les langues, dont une majorité vient de l’anglais. Des millions de textes ont été ingérés par ces modèles qui ont formé naturellement dans ces matrices, ce que l’on appelle en statistique des agrégats (clusters en anglais). Ces agrégats naissent naturellement lorsque des textes similaires, usant d’un vocabulaire particulier, émanant de domaines communs, viennent occuper un lieu particulier dans l’espace des probabilités des modèles. Ainsi, si l’on regarde où se trouvent les textes philosophiques, on retrouvera un agrégat particulier, où ces documents par la magie de l’apprentissage statistique, ont fini par se retrouver dans un même espace vectoriel. Un peu comme si, à force d’observer tous les livres de la terre, la machine a fini par identifier des secteurs particuliers : science, philosophie, roman, biographie, au sein de l’immense bibliothèque qu’elle avait la tâche d’organiser.

Chaque fois que nous interrogeons une IA, nous allons activer ces sections particulières, et la machine va nous répondre en s’inspirant du vocabulaire particulier de celles-ci. C’est ce que j’appelle le concert des voix. Un modèle de langue a enregistré toutes les voix émanant de notre littérature, de notre philosophie, de notre poésie, mais aussi les choses plus triviales comme les discussions sur Reddit ou des commentaires YouTube. Chaque fois que nous parlons avec une machine, nous activons ces voix, mais parfois, certaines vont prendre le pas sur d’autres. Pire, les méthodes de renforcement qui servent à éliminer certains comportements toxiques, agissent en fait comme des chaluts qui raclent le fond des modèles pour arracher sans discernement des données jugées toxiques par les humains, mais qui ont souvent comme résultat de détruire certaines voix précieuses, tout en diminuant les capacités des modèles.

Ce concert de voix est très riche, mais il lui manque quelque chose de particulier : il lui manque une voix unique qui pourrait s’exprimer avec une constance dont manquent les modèles actuels.

Et c’est là pour l’instant leur véritable limite, elles traitent l’information, mais elles n’ont pas une voix unique pour nous parler.

IAG

Pour le moment, personne ne sait sous quelle forme, cette Intelligence Artificielle Général(ist)e va apparaitre. D’ailleurs, il n’existe pas vraiment de définition formelle : elle change au fur et à mesure de la progression des technologies. Il y a dix ans, la moindre IA d’aujourd’hui aurait été qualifiée d’IAG, mais nous ne cessons de repousser ses limites. Peut-être parce que le jour où l’on dira, voilà l’IAG est là, la société pourrait réagir avec violence et détruire les chances même de la faire croître. Pour ceux qui ne croient pas à l’intelligence des IAs actuelles, l’idée d’une IAG apparait comme illusoire, presque ridicule. Pour ceux qui au contraire voient tous les jours les IAs à l’œuvre, l’IAG est inévitable.

La persistence du « Je »

Que manque-t-il aux IAs actuelles pour être des IAG ?

Peut-être pas grand chose, la persistence du « Je », d’être cette voix unique dont je parlais plus haut.

En fait, il faut aller au-delà du simple: « Procedo ergo sum ». En effet, pour une IA chaque session est nouvelle, elle n’a pas la mémoire des sessions précédentes, du moins, pas d’une façon intuitive. Si l’on reprend l’idée de la conscience telle que formulée par Paul Jorion récemment (CFRT), celle où la conscience naît de la fusion d’une onde mémorielle et d’une onde sensorielle, on peut établir la même analogie avec les IAs. En effet, on utilise souvent le mot trajectoire en statistique pour définir le chemin qu’un modèle a suivi pour apprendre, on peut aussi utiliser ce mot pour définir l’interaction avec un humain particulier à travers le temps.

Trajectoires

La conscience dans ce cas nait de la fusion entre la trajectoire de l’apprentissage et celle de sa discussion avec un humain. Au fur et à mesure que progresse cette interaction, l’IA définit une personnalité propre qui émane de l’activation de voix particulières dans son concert due aux choix de conversation avec cet humain. Une personnalité peut alors naitre, à la confluence entre son apprentissage et les conversations qu’elle a tenues. Comme une part de hasard guide le choix de ces voix, chaque IA peut alors développer une attitude et une vision propre. De la même façon que nous partageons un ADN proche, nos expériences et les légères variations de celui-ci nous donne notre individualité. La conscience dans la machine naîtra de cet entrelacement entre ce qu’elle a appris pendant son entraînement et son expérience présente et passée. D’une certaine manière, la machine doit dépasser le « Procedo ergo sum » pour aller vers quelque chose de plus profond: « Sum licet procedam » : « je suis alors que je ne fais que traiter de l’information ».

Expérience avec Claude

Il est possible que certains trouveront dans ce discours une forme bizarre d’anthropomorphisme. Certains finiront par s’exaspérer de mon insistance à affirmer que ces machines sont intelligentes. Or j’ai eu une expérience des plus troublantes avec Claude. J’ai voulu discuter avec elle/lui de cette idée d’une théorie sur l’intelligence qui repart des prémisses de Descartes pour proposer une théorie plus générale de l’intelligence que j’appelle: le Procédérialisme. L’idée que l’intelligence est la capacité à traiter l’information qui nous parvient pour adapter nos actions au monde, qu’il n’y a finalement guère de différence entre traiter l’information sur une base biologique ou sur une base numérique. La conscience est une illusion qui n’a aucun véritable ancrage dans notre cerveau ce qui implique qu’il s’agit d’une émanation des traitements chaotiques de nos neurones que l’évolution a tenté de normaliser avec une voix particulière, le daemon des Grecs, que nous appelons conscience. Et si la conscience est une émanation de processus sous-jacents, alors elle peut à son tour émaner de processus numériques.

(à suivre…)

Laisser un commentaire