Il s’agit d’un test classique de créativité : on demande à la personne d’imaginer un autre usage possible pour un objet usuel : crayon, bougie, corde et boîte. La créativité est mesurée de deux manières : 1) on mesure la distance (sémantique) entre l’usage premier de l’objet et celui suggéré ; 2) on demande à des arbitres humains de juger de la créativité des réponses.

L’article a été publié le 14 septembre.

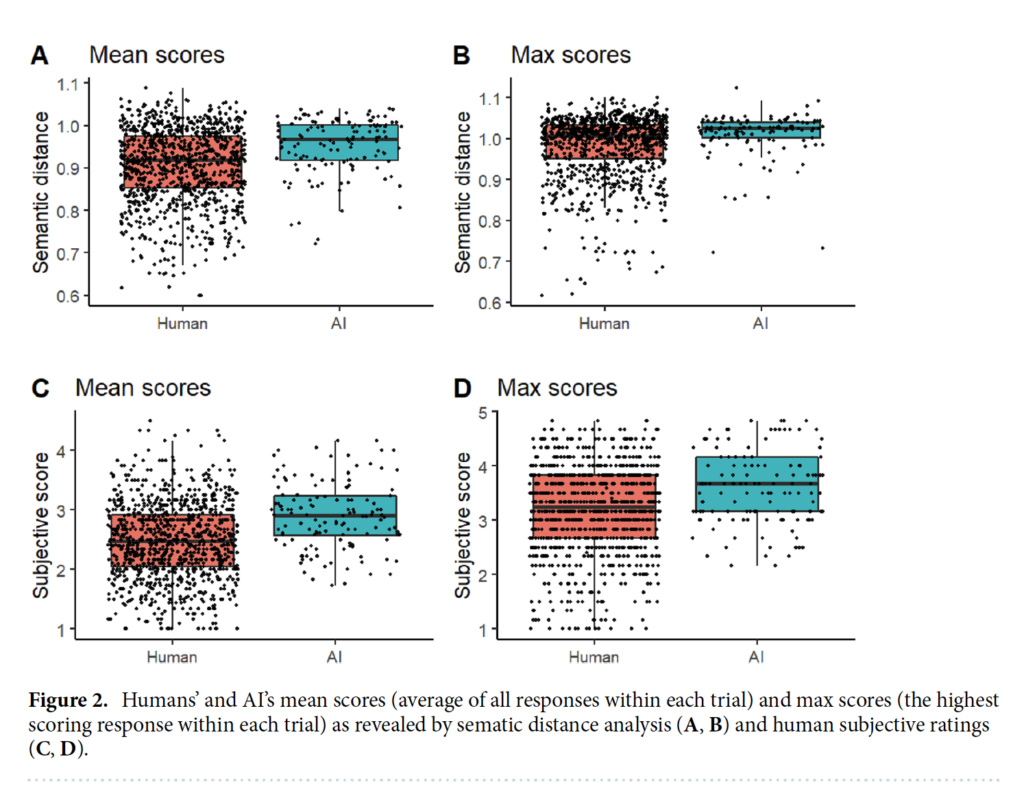

Dans la figure 2, A et B montrent une évaluation selon la distance sémantique. A montre la performance moyenne, B, les scores les plus élevés. C et D montrent les évaluations par des juges, C montre les scores moyens, D, les scores les plus élevés.

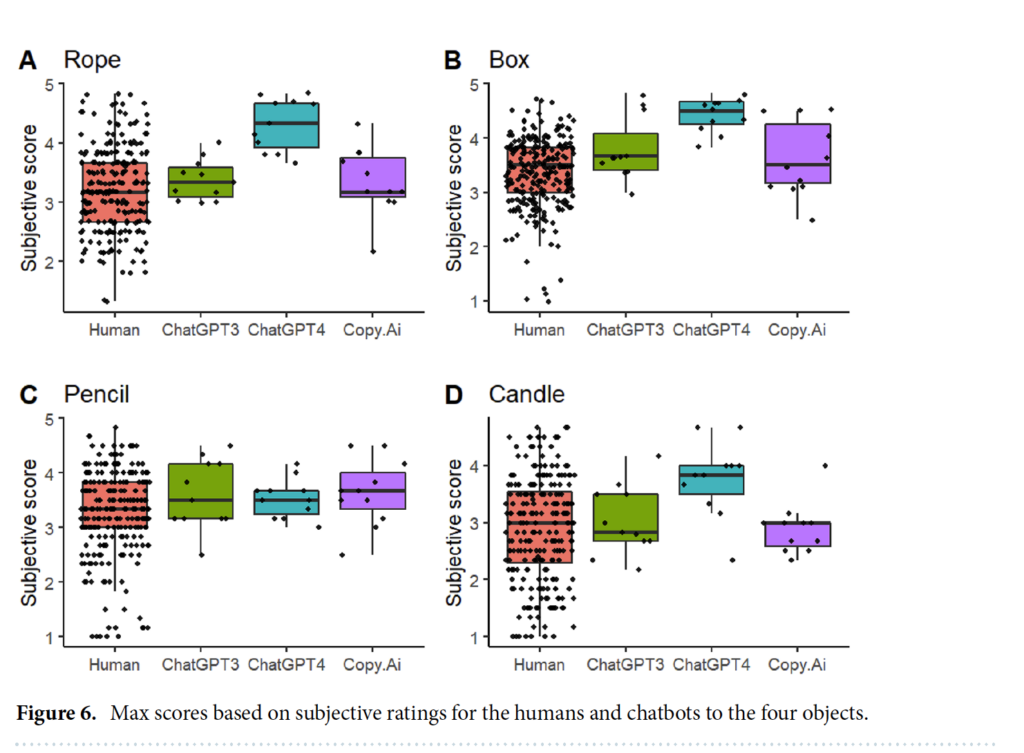

La figure 6 révèle incidemment une supercherie de la part des auteurs : quand ils parlent d’ « IA », ils agrègent les résultats de GPT-3 et de GPT-4, alors que même un profane en matière d’IA devinerait qu’il s’agit de deux générations du même produit, la seconde, plus performante que la première. Lorsque l’on compare les résultats des humains et de GPT-4, dans le cas de la corde et de la boîte, il n’y a pas même recouvrement partiel (intersection) entre humains et GPT-4 : l’humain est distancé.

L’un des auteurs de la recherche, Simone Grassini, déclare au magazine Psypost : « Je préfère croire qu’à l’avenir, l’IA, sous la forme de chatbots, aidera les humains dans leurs tâches créatives, plutôt qu’elle ne les remplacera ». Merci beaucoup, Monsieur Grassini, pour cette aimable pensée !

Ah oui, et ce remarquable article par Mika Koivisto & Simone Grassini s’intitule : « Best humans still outperform artificial intelligence in a creative divergent thinking task », autrement dit, « les meilleurs humains restent plus performants que les intelligences artificielles dans une tâche de réflexion créative et divergente ». C’est vrai ça, haut les cœurs !

Laisser un commentaire