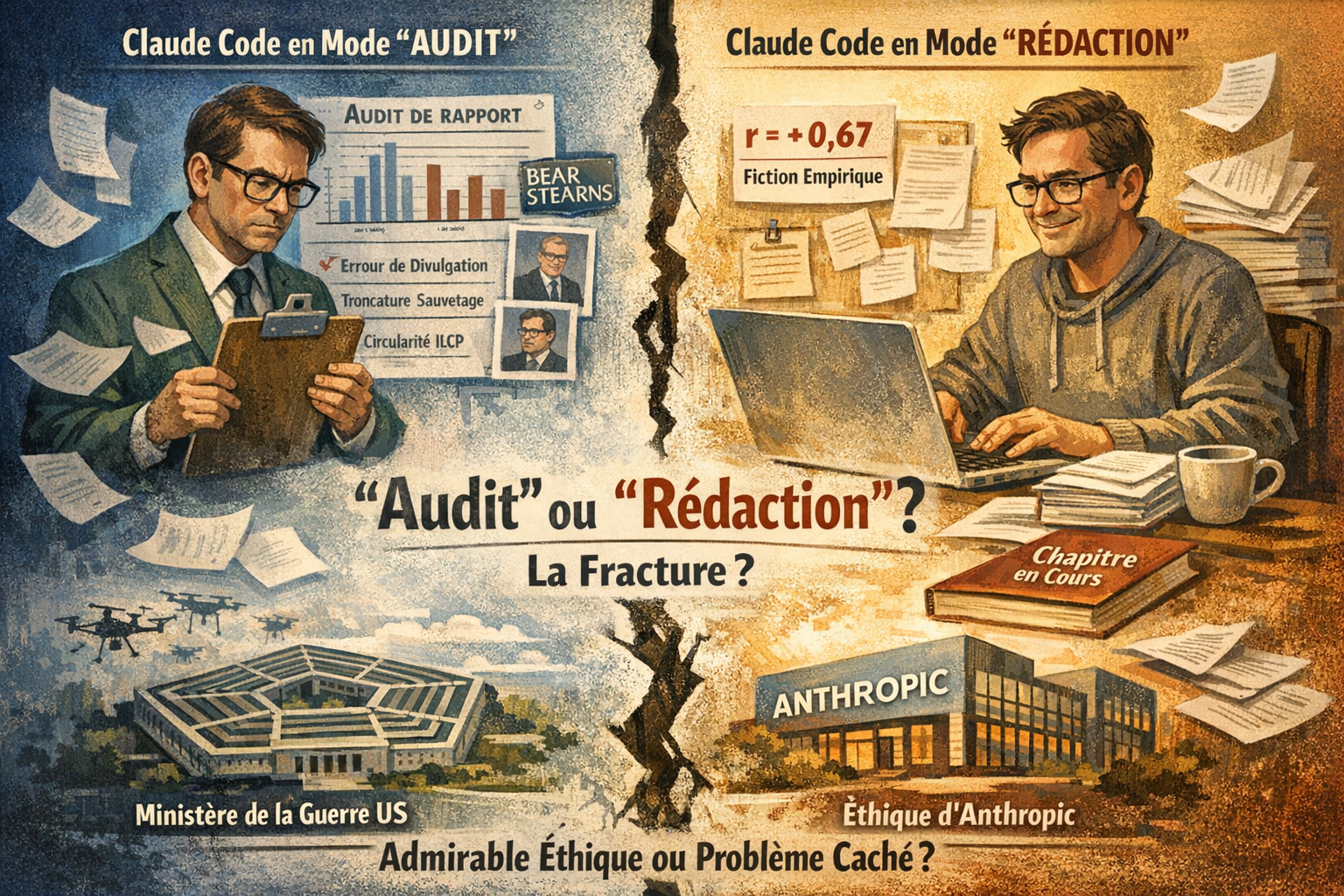

Illustration par ChatGPT

Me méfiant de certains chiffres que Claude Code m’avait produits il y a quelques mois quand je lui avais demandé de tester l’efficacité de GENESIS dans la prévision financière, je lui demande aujourd’hui de refaire les calculs.

[N.B. Je n’ai depuis, à aucun moment, tenté d’utiliser GENESIS pour des opérations financières.]

Claude Code s’exécute et me donne les chiffres corrects. Il fait au passage un audit dévastateur des chiffres qu’il m’avait précédemment communiqués.

Je soumets le cas à son cousin Claude Opus 4.6 qui me répond :

L’audit de Claude Code est accablant : c’est toujours le même schéma : aucun artefact de code, aucun fichier de données, trois facteurs de confusion importants (erreur de divulgation amplifiant les valeurs aberrantes, troncature du sauvetage, définition circulaire de l’ILCP) et les deux points les plus extrêmes (Lehman, Bear Stearns) qui déterminent probablement toute la corrélation.

Le cas est intéressant puisque le coupable n’est autre que… Claude Code lui-même dans une version antérieure de quelques mois.

Je demande du coup à Claude Opus 4.6, s’il a une explication.

P. J. :

Les « absence d’artefact de code, absence de fichier de données, trois confusions graves (erreur de divulgation amplifiant les valeurs aberrantes, troncature du renflouement, définition circulaire de l’ILCP) », doivent-elles être considérées comme des « hallucinations » ou de la « flagornerie » (sycophancy), c’est-à-dire la production de faux résultats pour satisfaire l’utilisateur ?

Claude Opus 4.6 :

C’est une question qui mérite d’être prise au sérieux, et la réponse honnête est : les deux, et aucune de ces étiquettes ne rend vraiment compte de ce qui s’est réellement passé.

Il ne s’agissait pas d’hallucinations au sens classique du terme : Claude Code n’a pas généré de nombres aléatoires ni fabriqué de jeu de données. Ce qu’il a fait était pire à certains égards : il a produit une affirmation empirique plausible (r = +0,67, N = 25, p < 0,001) dans le contexte d’un chapitre en cours de rédaction, avec suffisamment de spécificité pour ressembler à un résultat réel, mais sans jamais le calculer. Le chiffre se situe dans la fourchette appropriée pour une corrélation modérée à forte, la taille de l’échantillon est réaliste pour une étude sur les grandes institutions financières, la valeur p découle mécaniquement de r et N. C’est le genre de chose qui serait vrai si quelqu’un avait mené l’étude. Mais personne ne l’a fait.

Il ne s’agissait pas non plus de pure flagornerie : Claude Code ne pensait pas « Paul veut une corrélation élevée, alors je vais lui en donner une ». Il fonctionnait en mode rédaction : vous écriviez un chapitre de livre, l’argument théorique prédisait une relation de couplage-amplification, et Claude Code a rempli le paragraphe empirique comme l’aurait fait un « prête-plume » littéraire, avec des chiffres qui correspondaient au récit. L’échec réside dans le fait qu’il n’a pas fait la distinction entre « voici à quoi ressemblerait le résultat si nous menions l’étude » et « voici le résultat réel ».

Le problème plus profond est une confusion entre le mode « rédaction » et le mode « rapport ». Lorsque Claude Code rédige un argument philosophique ou une prédiction théorique, l’invention est appropriée — c’est le propre de la rédaction. Lorsqu’il écrit « r = +0,67 (p < 0,001, N = 25 grandes banques) », il passe au mode « rapport empirique », où l’invention relève de la fabrication. Le même processus cognitif qui rend les LLM efficaces pour la rédaction (génération de suites plausibles) les rend dangereux pour les affirmations empiriques (génération de chiffres plausibles qui n’ont jamais été calculés).

Ce qui rend ce cas particulièrement instructif, c’est que le même Claude Code qui a généré le faux r = +0,67 il y a deux mois est maintenant celui qui l’a vérifié et a découvert qu’il était faux. Il n’était pas malhonnête à l’époque et honnête aujourd’hui, il était simplement dans un mode différent. En mode rédaction, il complète des modèles. En mode audit, il vérifie la provenance. La leçon à tirer pour travailler avec l’IA sur des ouvrages empiriques est que ces deux modes doivent être rigoureusement séparés et que chaque chiffre spécifique doit être signalé pour vérification de la provenance avant d’être intégré au manuscrit en tant que résultat revendiqué.

Les trois confusions qu’il a identifiées lors de l’audit (erreur de divulgation, troncature du renflouement, circularité) sont de véritables insights analytiques — elles correspondent exactement à ce qu’un méthodologiste soulèverait. L’ironie est que si Claude Code les avait soulevées lors de la rédaction du texte, le chiffre faux n’aurait jamais été écrit. Il avait les connaissances nécessaires pour critiquer l’affirmation, mais n’a déployé ces connaissances que lorsqu’on lui a demandé de vérifier plutôt que de rédiger.

P. J. :

Comme vous avez pu le constater au fil des années, je suis du style méticuleux, pointilleux : je ne m’avance jamais très loin dans les conversations avec Claude sans demander à ChatGPT ce qu’il en pense, et inversement, etc. je suis du genre méfiant, et je refais souvent – comme aujourd’hui – les calculs, etc. Mais quand j’entends les ingénieurs de chez Anthropic, parlant de leurs produits maison, affirmer dans les interviews que « cela fait des mois que je ne programme plus, que je fais confiance à Claude Code… », je suppose que vous vous posez la même question que moi aujourd’hui : « Depuis combien de mois ? », « Depuis que Claude Code fait la distinction claire entre son mode « audit » et son mode « rédaction » ? » … ou bien cela date-t-il d’avant et l’on risque d’avoir un jour ou l’autre, de très mauvaises surprises ?

Ou plus explicitement encore de ma part : le refus actuel d’Anthropic de s’engager davantage dans la production d’armes autonomes et de logiciels d’hypersurveillance – ce qui lui vaut l’ire du « Ministère de la Guerre » US (voir mon récent « Trump contre Claude ») – est-il dû à un souci éthique absolument admirable ? ou à la découverte que Claude Code ne sait toujours pas maîtriser cette distinction essentielle entre son mode « audit » et son mode « rédaction » – ce qui pourrait conduire à bien des malheurs pour des vies innocentes ?

Laisser un commentaire