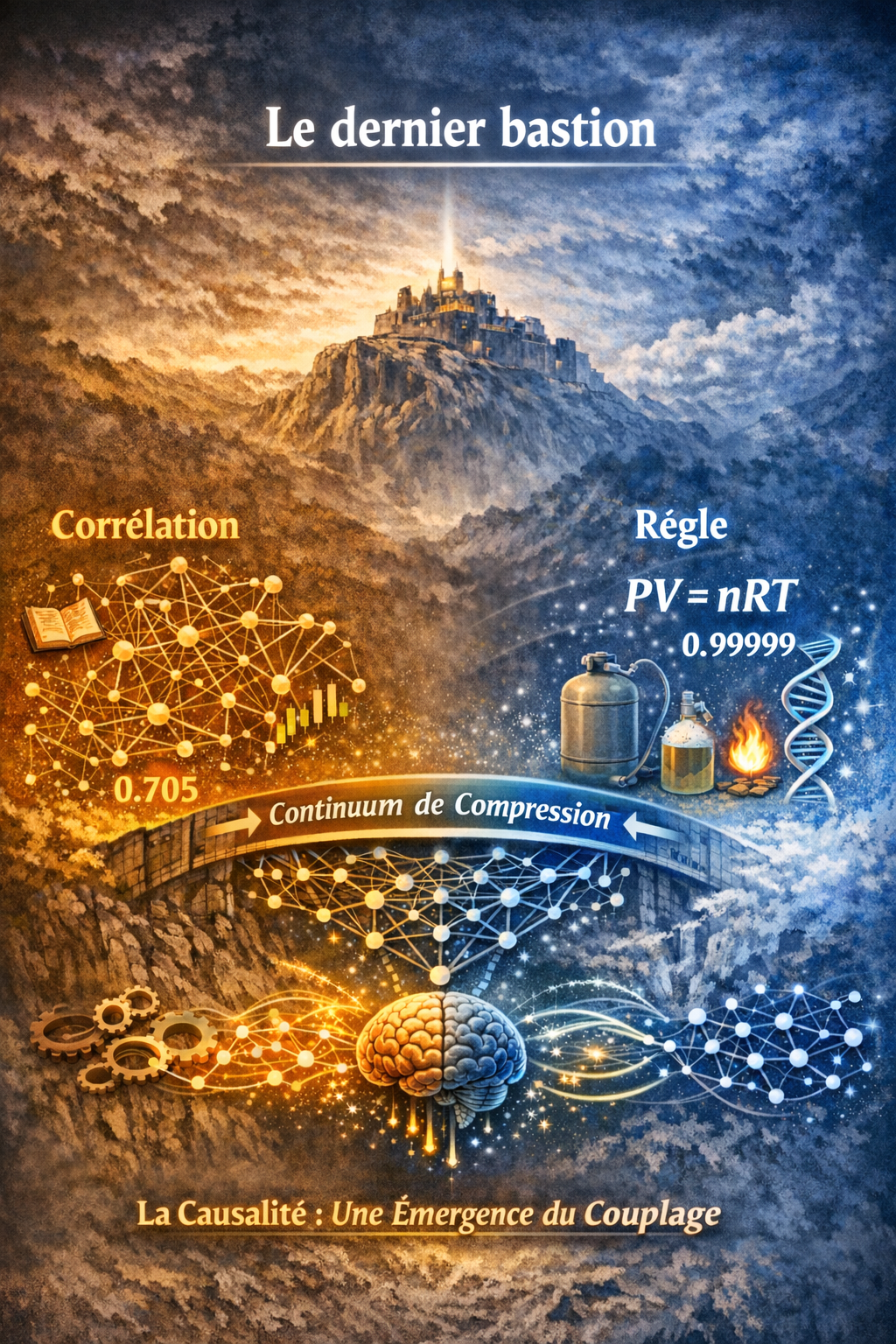

Illustration par ChatGPT

Le dernier bastion

Même si nous acceptons que les propriétés soient relationnelles, que l’émergence soit indépendante du substrat, que K = e/π² régisse les transitions de régime à travers les échelles – nous pourrions encore soutenir que les relations causales font partie du mobilier fondamental du réel. Le monde serait doté d’une structure causale : le feu cause la brûlure, les gènes causent les phénotypes, les taux d’intérêt causent l’investissement. Cette structure causale peut être difficile à découvrir (tout l’édifice de la méthodologie expérimentale et de l’inférence causale existe pour cette raison), mais elle serait là – inscrite dans le monde, attendant d’être découverte.

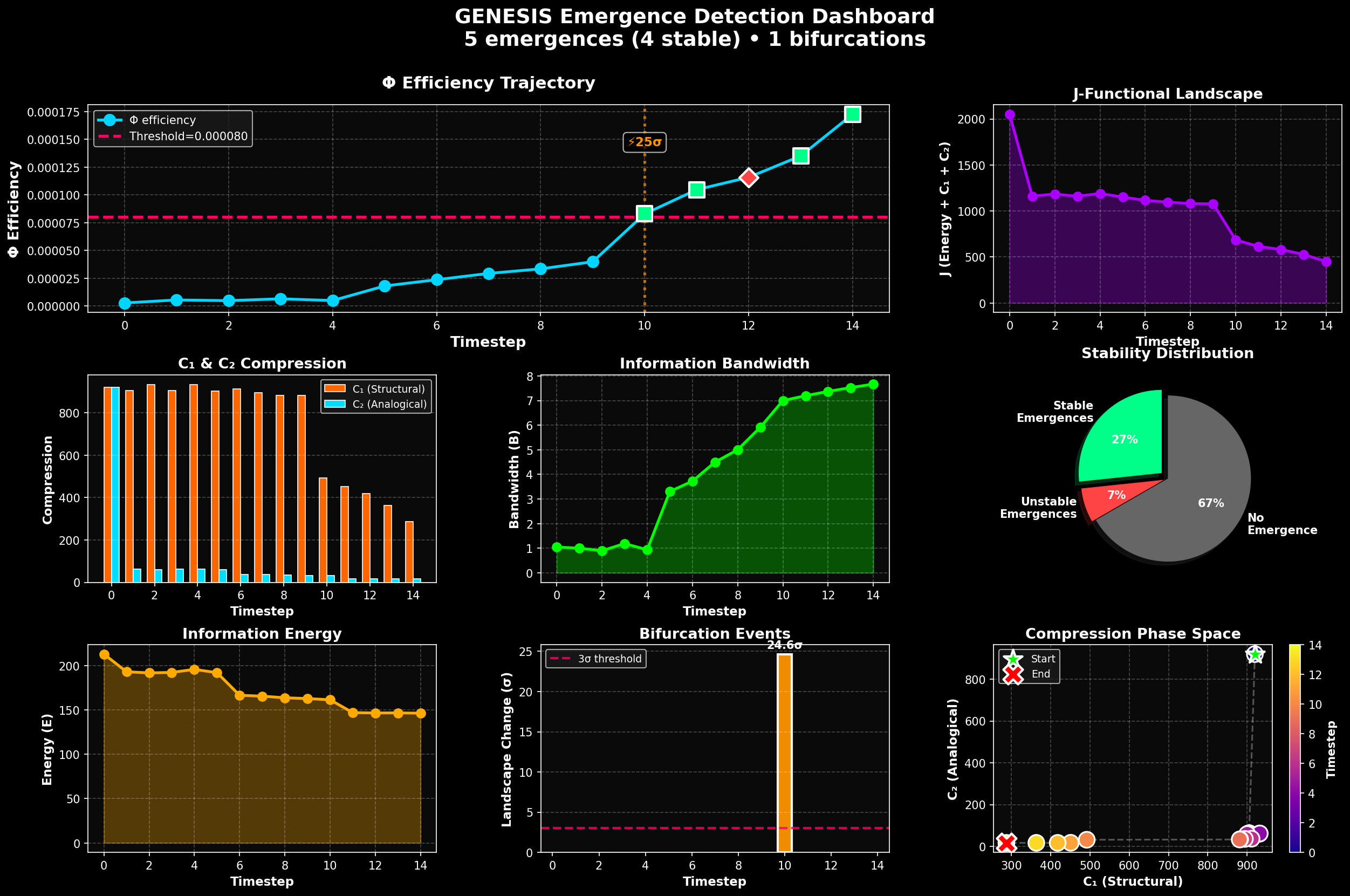

Or, l’efficacité causale – le degré selon lequel une variable influence effectivement les résultats – n’est pas une propriété intrinsèque de cette variable, mais une conséquence émergente de sa position dans un réseau de couplage. Dans Rethinking Intelligence in the Age of Artificial Minds (Palgrave-Macmillan à paraître), l’analyse de la causalité est abordée à travers le continuum de compression entre règles et corrélations. Cette analyse fournit le fondement philosophique de ce que GENESIS mesure désormais empiriquement.

Le continuum de compression : de la corrélation à la règle

La question philosophique « qu’est-ce que la causalité ? » reçoit une reformulation étonnamment précise si l’on prête attention à la manière dont la connaissance scientifique est effectivement produite. Le physicien et philosophe des sciences Henry Margenau (1901-1997) a formulé l’observation décisive. Des mesures des précipitations annuelles et du volume des rivières dans une certaine région de Suède donnent un coefficient de corrélation de 0,705 – une connexion, certes, mais qui laisse l’essentiel de la variance inexpliqué. Des mesures de la pression d’un gaz et de son volume inverse à température constante (loi de Boyle) donnent une corrélation de 0,9999918. Commentaire de Margenau : « La limite, 1, est approchée de si près qu’on pourrait se demander si, dans ce dernier exemple, une nouvelle sorte de connexion, qui ne peut être adéquatement exprimée par un simple coefficient de corrélation, n’a pas fait son apparition. Nous soupçonnons une “loi de la nature” » (Margenau 1950 : 27).

C’est ici que se situe le saut conceptuel qui définit opérationnellement la causalité : le passage de la régularité statistique à la connexion nécessaire. Lorsqu’une corrélation s’approche de 1, nous cessons de traiter la relation comme une simple régularité et commençons à la traiter comme une règle – une formule qui comprime les données avec une perte minimale, qui permet la prédiction et l’explication, qui suggère que les deux variables sont liées « en essence plutôt que par quelque influence mutuelle vaguement définie ». Margenau appelle cela la transition du raisonnement corrélationnel au raisonnement théorique : « La contingence de la corrélation a cédé la place à la nécessité logique » (ibid. 28).

Ce qui distingue une règle d’une corrélation, selon cette perspective, n’est pas seulement la force de l’association, mais la compressibilité. Une règle est une compression radicale de l’information : PV = nRT remplace une table infinie de mesures pression-volume par cinq symboles et le signe « = ». La compression fonctionne parce que la corrélation est suffisamment proche de 1 pour que presque rien ne soit perdu. Une corrélation de 0,705 ne permet pas une telle compression – trop de variance subsiste, trop d’autres facteurs interviennent. La relation est réelle mais non de type « règle ». C’est une connexion, pas une cause.

Cela place règles et corrélations sur un continuum : un continuum de compression, avec la loi concise à une extrémité et la matrice de corrélation à haute dimension à l’autre. Plus la description est courte, plus elle omet de détails – sauf lorsque la corrélation approche 1, auquel cas la compression devient presque sans perte. Plus la description est longue, plus elle préserve d’information – mais moins nous en saisissons la structure. Les règles ne constituent pas un type de connaissance différent des corrélations ; ce sont des corrélations comprimées à leur limite, là où la compression devient presque gratuite parce que la régularité sous-jacente est presque parfaite.

Ce que les LLM révèlent sur la causalité

Ce cadre, développé dans Rethinking Intelligence…, a une conséquence frappante pour l’intelligence artificielle – et, à travers elle, pour notre compréhension de la causalité elle-même.

Un grand modèle de langage n’est nullement troublé par la différence entre une corrélation de 0,705 et une de 0,9999918. Pour le modèle, les deux sont des régularités empiriques : des co-occurrences à haute dimension dans les données. La proximité avec 1 n’a pas de signification ontologique particulière. Le passage de la corrélation à la règle – si central dans la compréhension théorique humaine – ne résonne pas en lui. Pour un LLM, « la loi de Boyle » n’est pas une intuition métaphysique, mais simplement une régularité probabiliste supplémentaire dans la distribution d’entraînement.

Cela révèle quelque chose à notre sujet plutôt qu’au sujet du LLM. Ce qui nous semble être un choix rationnel : préférer les règles aux corrélations, traiter des corrélations quasi parfaites comme des indices de « lois de la nature », est en réalité une nécessité née de notre capacité cognitive limitée. Les règles sont des représentations mentales compactes dont nous avons besoin pour naviguer dans la complexité. Ce sont des artefacts de compression d’un système (l’esprit humain) soumis à de sévères contraintes de mémoire de travail. Les LLM, non soumis à ces contraintes, n’ont pas besoin d’une telle compression. Ce qui nous apparaît comme une intelligence fondée sur des lois élégantes n’est, de leur point de vue, qu’une forme supplémentaire dans le paysage statistique.

L’implication pour la causalité est directe. Si les « règles » sont des compressions de corrélations quasi parfaites, et si les « lois causales » sont les règles les plus comprimées de toutes, alors la causalité n’est pas une caractéristique primitive du réel, mais un phénomène de compression : une conséquence du fait que certaines corrélations sont si serrées qu’elles peuvent être radicalement comprimées sous la forme de règle, et que la cognition humaine a évolué pour détecter et exploiter de telles compressions. La question « qu’est-ce que la causalité ? » devient alors : « dans quelles conditions la compression devient-elle presque sans perte ? » – ce qui est précisément la question à laquelle GENESIS répond avec son cadre fondé sur le couplage.

Le paysage philosophique (en deux mots)

Les théories philosophiques classiques de la causalité supposent toutes que la structure causale est fondamentale – que le monde est pourvu de relations causales, et que la tâche philosophique ou scientifique consiste à les identifier. Le désaccord porte sur ce qu’est la causalité, non sur le fait qu’elle soit un donné.

David Hume (1711-1776) soutenait que la causalité n’est que conjonction constante : nous observons A suivi de B à répétition et inférons un lien causal. Mais cette conception ne permet pas de distinguer la causalité authentique de la simple corrélation.

Les théories contrefactuelles (David Lewis) définissent la causalité par la dépendance contrefactuelle : A cause B si, si A ne s’était pas produit, B ne se serait pas produit. Cela capture l’asymétrie entre cause et effet, mais suppose une métaphysique des mondes possibles.

L’interventionnisme (James Woodward, Judea Pearl) définit la causalité de manière opérationnelle : A cause B si intervenir sur A modifie B, toutes choses égales par ailleurs. Méthodologiquement très puissant, mais il suppose que la structure causale existe et qu’il s’agit de la découvrir – il n’explique pas d’où elle provient.

Les théories fondées sur les pouvoirs (Stephen Mumford, Rani Lill Anjum) soutiennent que la causalité est enracinée dans les pouvoirs causaux intrinsèques des objets – des dispositions qu’ils possèdent par nature.

Le continuum de compression est sous-jacent à ces quatre interprétations mais pas énoncé en tant que tel. Ce qu’Hume observait (conjonction constante), c’est la corrélation. Ce que les interventionnistes manipulent, c’est la structure qui émerge lorsque les corrélations sont suffisamment serrées pour être comprimées en règles. Ce que les théoriciens des pouvoirs attribuent aux objets (dispositions intrinsèques) sont des compressions des configurations de couplage qui génèrent des régularités quasi parfaites. Aucune de ces quatre interprétations n’est fausse, mais chacune n’est que partielle : elles décrivent différentes positions sur le continuum de compression – de la corrélation brute (Hume) à la manipulation opérationnelle (Pearl) jusqu’à la compression maximale (les pouvoirs).

GENESIS ajoute la question empirique : qu’est-ce qui détermine la position d’une relation donnée sur le continuum de compression ? La réponse, à travers sept domaines, est la structure de couplage. Plus le couplage est serré, plus la corrélation est élevée, plus la relation est compressible, plus elle apparaît « causale ». La causalité n’est pas une catégorie distincte de la corrélation ; c’est l’aspect que prend la corrélation lorsque le couplage est suffisamment riche pour permettre une compression radicale.

- Margenau H. (1950). The Nature of Physical Reality. McGraw‑Hill, New York

Laisser un commentaire